Context Window Management

쉽게 이해하기

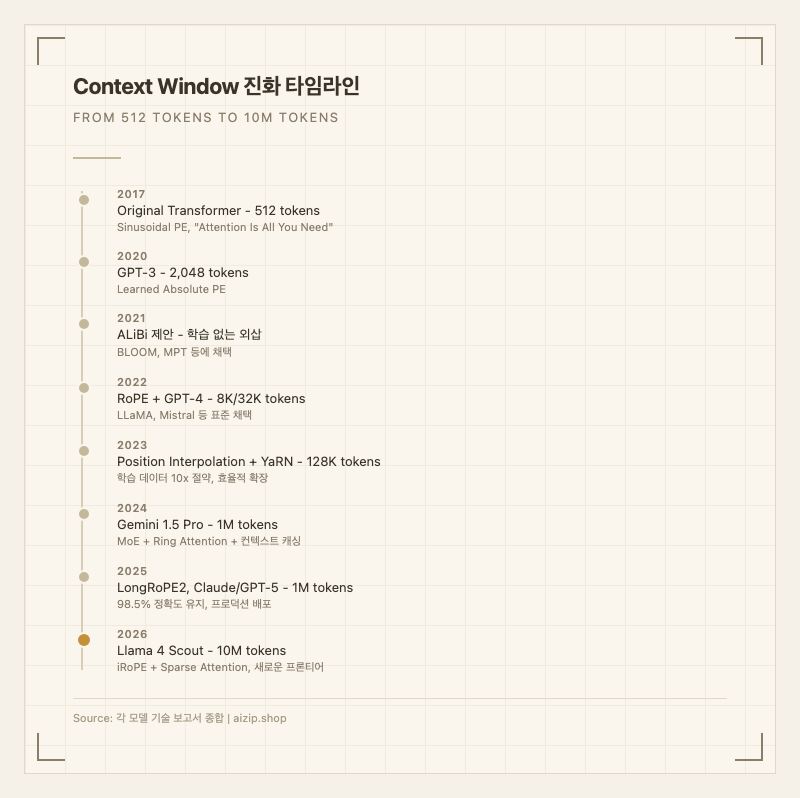

도서관에서 책을 읽는 상황을 떠올려 보자. 한 번에 펼칠 수 있는 책의 분량이 곧 "컨텍스트 윈도우"다. 2017년 초기 트랜스포머는 한 번에 약 512개 토큰(A4 한 장 분량)만 읽을 수 있었다. 마치 책 한 쪽만 펼쳐 놓고 전체 줄거리를 파악하려는 것과 같았다. Context Window Management는 이 "한 번에 읽을 수 있는 분량"을 효율적으로 늘리고, 늘어난 분량 속에서 중요한 정보를 놓치지 않도록 관리하는 모든 기법을 포괄하는 방법론이다.

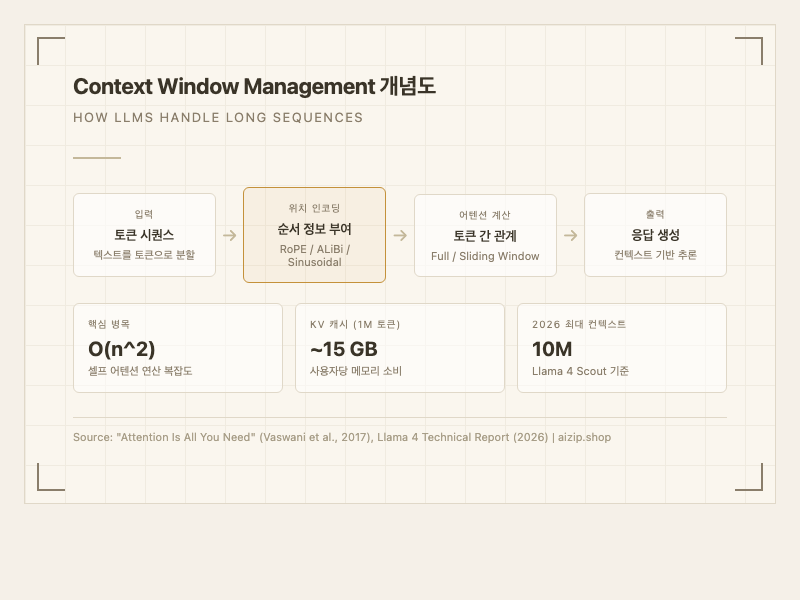

기존 방식은 단순했다. 입력이 컨텍스트 한계를 넘으면 앞부분을 잘라내거나(truncation), 여러 조각으로 나눠 따로 처리했다. 이 방식은 문서 전체를 이해해야 하는 요약, 코드 분석, 대화 이력 추적 같은 작업에서 치명적인 한계를 보였다. Context Window Management는 위치 인코딩(Positional Encoding), 어텐션 패턴 최적화, 컨텍스트 확장 기법이라는 세 축으로 이 문제를 해결한다. 위치 인코딩은 각 토큰에 "몇 번째 위치"라는 꼬리표를 붙이는 방식이고, 어텐션 패턴은 모든 토큰이 서로를 참조하는 대신 가까운 이웃만 보는 효율적 방식을 도입하며, 컨텍스트 확장은 학습 때보다 더 긴 입력도 처리할 수 있게 위치 인코딩을 보간(interpolation)하거나 외삽(extrapolation)하는 기법이다.

2026년 현재 @Google Gemini는 최대 2M 토큰, @ChatGPT와 @Claude는 1M 토큰의 컨텍스트 윈도우를 제공하며, Llama 4 Scout는 10M 토큰이라는 전례 없는 규모를 달성했다. @NotebookLM은 긴 문서를 통째로 분석하고, @Claude Code는 대규모 코드베이스를 한 번에 파악하는 데 이 기술을 활용한다. 이 비유의 한계: 실제로는 "읽는 분량"만 늘리면 되는 게 아니라, 긴 텍스트 중간에 있는 정보가 묻히는 "Lost in the Middle" 문제가 있어 단순히 양을 늘리는 것과는 다른 도전이 존재한다.

기술 심층 분석

선수학습: 이 내용을 이해하려면 트랜스포머의 셀프 어텐션 메커니즘에 대한 기본 이해가 필요합니다.

핵심 아키텍처

Context Window Management의 핵심은 세 가지 기술 축으로 구성된다.

1. 위치 인코딩 (Positional Encoding)

트랜스포머는 순환 구조가 없어 토큰의 순서 정보를 별도로 주입해야 한다. 주요 방식은 다음과 같다.

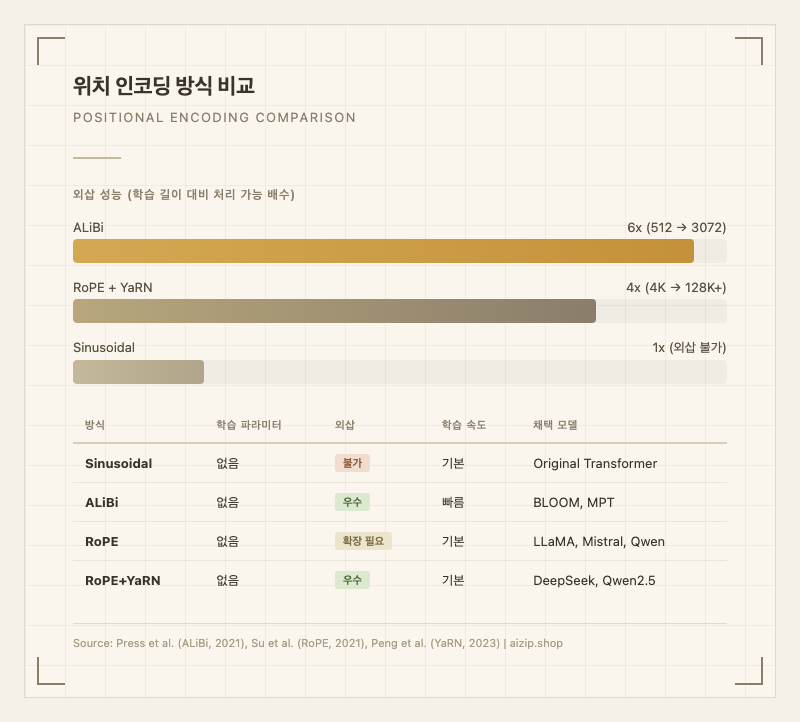

Sinusoidal PE (Vaswani et al., 2017): 원래 트랜스포머에서 사용된 고정 함수 기반 인코딩이다.

여기서 는 토큰 위치, 는 차원 인덱스, 은 임베딩 차원이다. 학습 파라미터가 없고 모든 길이에 일반화할 수 있다는 장점이 있지만, 실제로는 학습 길이를 넘어서면 성능이 급격히 저하된다1.

RoPE (Rotary Position Embedding) (Su et al., 2021): 2D 회전 행렬을 이용해 절대 위치를 인코딩하면서도 상대 위치 정보를 자연스럽게 포함시키는 방식이다.

여기서 은 위치, 는 주파수 기저(base frequency)로 기본값은 이다. 쿼리와 키에 각각 회전을 적용하면 내적 계산 시 자동으로 상대 거리 에 의존하는 어텐션 패턴이 형성된다. 현재 LLaMA, Mistral, Qwen, DeepSeek 등 대부분의 최신 LLM이 RoPE를 표준으로 채택하고 있다2.

ALiBi (Attention with Linear Biases) (Press et al., 2021): 임베딩 레벨이 아닌 어텐션 점수에 직접 선형 편향을 더하는 방식이다.

여기서 이고, 는 어텐션 헤드 인덱스다. 헤드 0은 기울기 1로 넓은 범위를, 마지막 헤드는 거의 0에 가까운 기울기로 좁은 범위를 담당해 멀티스케일 어텐션을 자연스럽게 구현한다. 512 토큰으로 학습한 모델이 3072 토큰에서도 Sinusoidal 기반 모델보다 낮은 perplexity를 보인다 (Press et al., 2021, Table 3). BLOOM, MPT 등에 채택되었다3.

2. 어텐션 패턴 최적화

Sliding Window Attention: 전체 시퀀스 대신 고정 크기 윈도우 내의 토큰만 참조하여 어텐션 복잡도를 에서 로 줄인다. Mistral 7B에서 4096 토큰 윈도우로 사용되어 효율적인 긴 시퀀스 처리를 가능하게 했다. Gemma 3는 로컬(Sliding Window)과 글로벌 어텐션 레이어를 교대 배치하는 하이브리드 방식을 사용한다4.

FlashAttention: 어텐션 연산의 메모리 병목을 타일링(tiling)과 재계산(recomputation)으로 해결하여, 중간 행렬의 메모리 복잡도를 에서 으로 줄이면서 2-4배 속도 향상을 달성한다. FlashAttention-3는 H100 GPU에서 1.3 PFLOP/s를 달성했다 (Shah et al., FlashAttention-3 논문)5.

Ring Attention: 여러 GPU에 시퀀스를 분할하고, 링 형태로 KV 블록을 순환하며 부분 어텐션을 계산한 뒤 결과를 집계한다. 메모리 복잡도를 에서 으로 줄이며, 128개 H100 GPU에서 405B 모델 기준 93% 효율을 달성한다 (Exxact Corp, Context Parallelism 벤치마크)6.

3. 컨텍스트 확장 기법

학습 시 사용한 컨텍스트 길이를 넘어서는 입력을 처리하기 위한 기법들이다.

Position Interpolation (PI) (Chen et al., 2023): 위치 인덱스를 학습 길이 비율로 선형 축소한다. 예를 들어 4K로 학습한 모델에서 16K 입력을 처리할 때 위치를 로 보간한다.

NTK-aware Interpolation: PI의 한계를 보완한다. 고주파 성분의 손실을 방지하기 위해 RoPE의 기저 주파수 를 조정한다.

YaRN (Yet Another RoPE extensioN) (Peng et al., 2023): NTK-by-parts 방식과 어텐션 온도(temperature) 스케일링을 결합한 방법으로, 기존 대비 10배 적은 토큰과 2.5배 적은 학습 스텝만으로 컨텍스트 확장이 가능하다. Qwen, DeepSeek, LLaMA 등 현재 대부분의 LLM이 YaRN을 사용해 컨텍스트를 확장한다 (Peng et al., 2023, Table 1)7.

LongRoPE2 (2025): LLaMA3-8B의 컨텍스트를 128K까지 확장하면서 원래 짧은 컨텍스트 성능의 98.5% 이상을 유지한다 (LongRoPE2, OpenReview)8.

성능 및 비교

| 위치 인코딩 | 학습 파라미터 | 외삽 능력 | 학습 속도 | 채택 모델 | 출처 |

|---|---|---|---|---|---|

| Sinusoidal | 없음 | 불가 (학습 길이 초과 시 즉시 저하) | 기본 | Original Transformer | Vaswani et al., 2017 |

| ALiBi | 없음 | 우수 (학습 길이의 6배까지) | 빠름 | BLOOM, MPT | Press et al., 2021 Table 3 |

| RoPE | 없음 | 제한적 (확장 기법 필요) | 기본 | LLaMA, Mistral, Qwen | Su et al., 2021 |

| RoPE + YaRN | 없음 (소량 파인튜닝) | 우수 (4K to 128K+) | 기본 | DeepSeek, Qwen2.5 | Peng et al., 2023 Table 1 |

| 컨텍스트 확장 기법 | 필요 학습량 | 확장 배율 | 성능 유지율 | 출처 |

|---|---|---|---|---|

| Position Interpolation | 소량 파인튜닝 | 4x~8x | ~95% | Chen et al., 2023 |

| YaRN | PI 대비 1/10 토큰 | 4x~32x | ~97% | Peng et al., 2023 Table 1 |

| LongRoPE2 | 소량 파인튜닝 | 32x (4K to 128K) | 98.5% | LongRoPE2, OpenReview 2025 |

| ALiBi (학습 불필요) | 없음 | ~6x | 동등 이상 | Press et al., 2021 Table 3 |

이 수치가 실무에서 의미하는 것: YaRN 기반 확장을 사용하면 4K 컨텍스트 모델을 128K 이상으로 확장하면서도 전체 재학습 대비 1/10의 비용으로 가능하다. ALiBi는 추가 학습 없이도 외삽이 가능하지만, 현재 업계 표준은 RoPE + YaRN 조합이다.

장점과 한계

장점

- 대규모 문서 일괄 처리: 1M+ 토큰 컨텍스트로 수백 페이지 문서를 한 번에 분석 가능. @NotebookLM은 이를 활용해 논문/책 전체를 컨텍스트에 올려 질의응답을 수행한다.

- 코드베이스 전체 이해: @Claude Code와 @GitHub Copilot은 프로젝트 전체 코드를 컨텍스트에 포함시켜 파일 간 의존성을 파악한다.

- 긴 대화 이력 유지: @ChatGPT와 @Claude에서 수십 턴의 대화를 끊김 없이 이어갈 수 있다.

- 비용 효율적 확장: YaRN으로 전체 재학습 없이 컨텍스트를 수십 배 확장 가능 (학습 데이터 10x, 학습 스텝 2.5x 절약, Peng et al., 2023).

- 컨텍스트 캐싱으로 비용 절감: 반복 프롬프트의 정적 부분을 캐싱하면 최대 90% 비용 절감 (Google Context Caching API 문서).

한계

- Lost in the Middle 문제: 컨텍스트 중간에 위치한 정보의 검색 정확도가 시작/끝 대비 30% 이상 하락한다 (Liu et al., "Lost in the Middle", TACL 2024). 해결 방향: Ms-PoE (Multi-scale Positional Encoding)로 중간 위치 감쇠를 보정하거나, 중요 정보를 시작/끝에 배치하는 전략적 프롬프트 설계.

- O(n^2) 연산 복잡도: 컨텍스트가 2배 증가하면 어텐션 연산은 4배 증가. 1M 토큰은 4K 대비 약 250배의 연산을 요구한다. 해결 방향: FlashAttention으로 I/O 병목 해소, Sliding Window로 근사 계산, Ring Attention으로 분산 처리.

- KV 캐시 메모리 폭발: 1M 토큰 처리 시 사용자당 약 15GB의 KV 캐시 메모리가 필요. 해결 방향: NVFP4 KV 캐시 양자화로 50% 절감, GQA(Grouped Query Attention)로 KV 헤드 수 감소.

- 외삽 한계: RoPE 기반 모델은 학습 길이를 넘으면 성능이 급격히 저하. ALiBi는 외삽에 강하지만 장거리 모델링에 제약이 있다. 해결 방향: YaRN/LongRoPE2 같은 확장 기법, 또는 iRoPE(Llama 4)처럼 하이브리드 접근.

- 평균 Recall ~60%: Gemini 1.5의 1M 토큰 환경에서 관련 정보의 평균 recall이 약 60%로, 40%의 정보가 사실상 유실된다 (Google AI, Long Context 벤치마크). 치명적 시나리오: 법률 문서 분석처럼 모든 조항을 빠짐없이 검토해야 하는 경우.

실무 적용 가이드

적합한 시나리오

- 문서 전체 요약/분석 (보고서, 논문, 법률 문서): 128K+ 컨텍스트 모델 필요

- 대규모 코드베이스 리팩토링: 파일 간 의존성 파악에 긴 컨텍스트 필수

- 멀티턴 대화 유지: 20턴 이상의 복잡한 대화에서 컨텍스트 유실 방지

- 전체 책/매뉴얼 기반 Q&A: RAG 대신 컨텍스트에 직접 로드 가능

부적합한 시나리오

- 짧은 단답형 질의: 4K 이하면 추가 기법 불필요, 오히려 비용 낭비

- 정보 위치가 중요한 정밀 검색: "Lost in the Middle" 문제로 RAG + 재순위화가 더 적합

- 엣지/모바일 디바이스: 메모리 제약으로 긴 컨텍스트 자체가 불가능

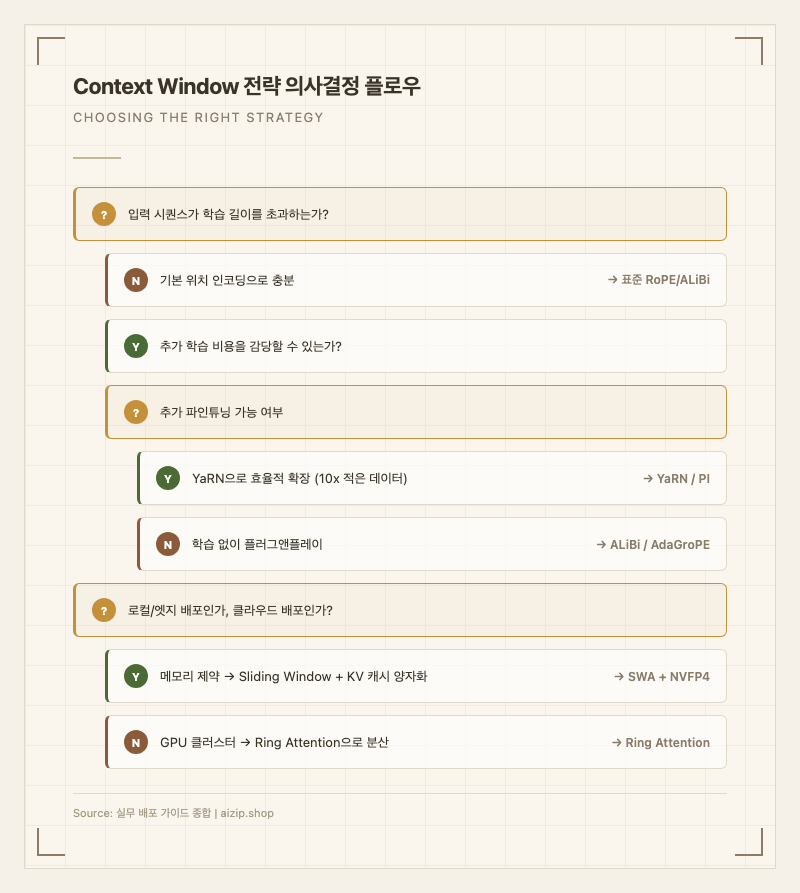

도입 판단 기준

- 평균 입력 길이가 8K 토큰 초과 -> 컨텍스트 확장 기법 검토

- GPU 메모리 80GB 이상 (A100/H100) -> 128K 이상의 긴 컨텍스트 운용 가능

- 반복 프롬프트 비율 50% 이상 -> 컨텍스트 캐싱으로 비용 절감 효과 극대화

- 정보 검색 정확도 99% 이상 필요 -> RAG와 긴 컨텍스트를 병합하는 하이브리드 전략 필요

추천 구성

- 일반적 긴 컨텍스트: RoPE + YaRN 확장 (비용 대비 성능 최적)

- 학습 없는 확장 필요: ALiBi 또는 AdaGroPE 플러그앤플레이 적용

- 프로덕션 최적화: FlashAttention-3 + KV 캐시 양자화 + 컨텍스트 캐싱

- 초대규모(1M+): Ring Attention 분산 + MoE 아키텍처

이 방법론을 사용하는 서비스: @Google Gemini (2M), @Claude (1M), @ChatGPT (1M), @Claude Code (1M), @GitHub Copilot, @NotebookLM, @Google AI Studio, @Notion AI, @Microsoft 365 Copilot, @Gemini

Footnotes

-

Vaswani et al., "Attention Is All You Need", NeurIPS 2017 ↩

-

Su et al., "RoFormer: Enhanced Transformer with Rotary Position Embedding", arXiv 2021 ↩

-

Press et al., "Train Short, Test Long: Attention with Linear Biases Enables Input Length Extrapolation", ICLR 2022 ↩

-

Mistral AI, "Mistral 7B Technical Report", 2023; Google, "Gemma 3 Technical Report", 2025 ↩

-

Shah et al., "FlashAttention-3: Fast and Accurate Attention with Asynchrony and Low-precision", 2024 ↩

-

Exxact Corp, "Context Parallelism & Ring Attention", Blog 2025 ↩

-

Peng et al., "YaRN: Efficient Context Window Extension of Large Language Models", ICLR 2024 ↩

-

"LongRoPE2: Near-Lossless LLM Context Window Scaling", OpenReview 2025 ↩