가이드2026년 3월 23일

AI 스타트업 API-First 전략 완전 가이드: 파운데이션 모델을 직접 만들지 말아야 하는 이유

## AI 스타트업이 파운데이션 모델을 직접 만들면 안 되는 이유

"우리만의 AI 모델을 만들어야 진짜 AI 회사 아닌가요?" 2026년에도 이 질문은 AI 스타트업 창업자들 사이에서 가장 흔한 착각 중 하나다. GPT-5 학습 비용이 17억~25억 달러로 추정되는 시대에, 초기 스타트업이 범용 파운데이션 모델을 처음부터 만드는 것은 발전소를 짓고 나서 전등을 켜겠다는 것과 같다. 이 글은 API-First 전략이 왜 2026년 AI 스타트업의 기본 생존 전략인지, 그리고 단순 API 래퍼가 아닌 방어 가능한 사업을 어떻게 설계하는지를 다룬다.

## 이 글의 대상과 난이도

- 대상: AI 제품을 기획 중이거나 초기 개발 단계에 있는 스타트업 창업자, CTO, 프로덕트 매니저

- 난이도: 입문~중급 (ML 전문 지식 불필요)

- 예상 소요시간: 읽기 15분

## 전체 구조

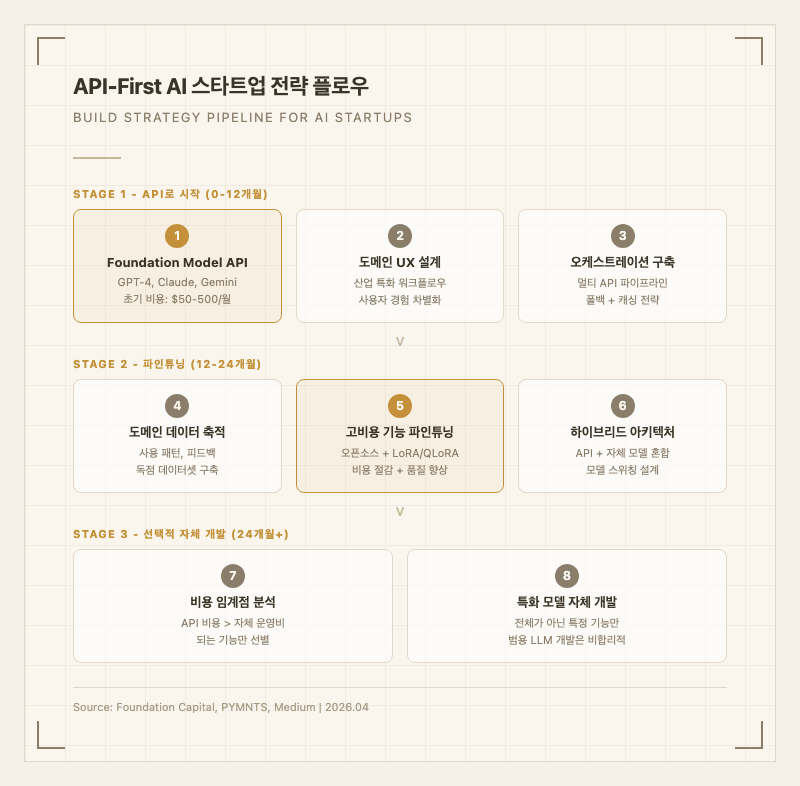

이 가이드는 3단계 진화 모델을 따른다. Stage 1에서 API로 빠르게 시작하고, Stage 2에서 데이터가 쌓이면 파인튜닝으로 비용을 최적화하며, Stage 3에서 정말 필요한 특화 영역만 선택적으로 자체 개발한다. 대부분의 스타트업은 Stage 1-2에서 충분한 경쟁력을 확보할 수 있다.

## 도구 선택: 왜 직접 만들면 안 되는가

### 비용의 현실

2026년 기준 프론티어 모델의 학습 비용은 천문학적이다. HSBC 추정에 따르면 GPT-5의 학습 비용은 17억~25억 달러에 달한다. GPT-4 수준만 해도 1억 달러 이상이 소요됐다. Meta의 Llama 3는 약 2,500만 달러, DeepSeek V3는 GPU 임대 비용만으로 560만 달러를 썼다고 발표했지만, SemiAnalysis는 DeepSeek의 실제 총 인프라 비용이 약 16억 달러에 달한다고 추정했다. 560만 달러라는 수치는 사전 연구, 아키텍처 실험, 인력 비용을 모두 제외한 순수 학습 비용일 뿐이다. (출처: PYMNTS, Techstrong.ai)

이 비용 격차가 의미하는 바는 명확하다. 시리즈 A 이전의 스타트업이 범용 LLM을 처음부터 학습시키는 것은 투자금 전액을 모델 하나에 소진하겠다는 뜻이다. 반면 API를 활용하면 초기 비용은 월 50~500달러 수준이고, 프론티어급 성능을 즉시 사용할 수 있다. (출처: Azilen, Coherent Solutions)

### 인력과 시간

자체 모델 개발에는 ML 연구자 10~50명 수준의 팀이 필요하고, 첫 프로토타입까지 12~24개월이 걸린다. API 활용 시 풀스택 개발자 2~3명으로 1~4주 안에 프로토타입을 만들 수 있다. 스타트업에서 12~24개월은 시장 기회를 통째로 놓칠 수 있는 시간이다. (출처: Coherent Solutions, cyfuture.ai)

### 성능 역설

가장 치명적인 부분은 성능이다. 수조 원의 자본과 수천 명의 연구자를 보유한 OpenAI, Google, Anthropic과 같은 수준의 범용 모델을 초기 스타트업이 만들어낼 가능성은 극히 낮다. 오히려 동일한 자원을 API 위에서 도메인 특화 UX와 오케스트레이션에 투자하면 훨씬 높은 사용자 가치를 만들 수 있다. Foundation Capital의 2026년 AI 전망 보고서는 "기업 환경에서 작은 맞춤형 모델이 프론티어 모델보다 더 좋은 성과를 낸다 - 더 빠르고, 더 저렴하고, 온프레미스 요구사항을 충족한다"고 지적했다. (출처: Foundation Capital)

## 실전 사용법: API-First 전략의 3단계

### Step

1: API로 시작 (0-12개월 | ~15분 읽기)

첫 단계는 Foundation Model API를 선택하고 도메인 특화 UX를 설계하는 것이다. 2026년 기준 주요 선택지는 다음과 같다.

**멀티 프로바이더 아키텍처 설계가 핵심이다.** 단일 API 제공업체에 의존하면 가격 인상이나 서비스 중단 시 사업 전체가 위험해진다. Google VP가 2026년 2월 TechCrunch 인터뷰에서 "LLM 래퍼와 AI 애그리게이터, 이 두 유형의 AI 스타트업은 살아남지 못할 수 있다"고 경고한 것도 이 맥락이다. 단순 래퍼는 마진 축소와 차별화 부재로 장기 생존이 어렵다. (출처: TechCrunch)

**Model-Agnostic 아키텍처를 설계해야 한다.** VC 업계에서 단일 프로바이더 의존은 점점 더 레드 플래그로 취급받고 있다. 오픈소스 모델이 상용 API와 경쟁하는 상황에서, 프로바이더를 언제든 전환할 수 있는 아키텍처가 투자자에게 중요한 평가 기준이 되고 있다. (출처: iexchange Substack)

```python

class AIProvider:

fallback_chain = ["openai", "anthropic", "google"]

async def complete(self, prompt, **kwargs):

for provider in self.fallback_chain:

try:

return await self._call(provider, prompt, **kwargs)

except (RateLimitError, ServiceUnavailable):

continue

raise AllProvidersFailedError()

```

체크포인트: 멀티 프로바이더 폴백이 동작하고, 하나의 API가 다운되어도 서비스가 중단되지 않으면 성공.

> 실패 경로: API 키 인증 오류가 나면 각 프로바이더의 API 키가 환경변수에 올바르게 설정됐는지 확인. Rate limit 에러가 빈번하면 요청 큐잉과 지수 백오프를 구현.

### Step

2: 데이터 플라이휠 구축과 파인튜닝 (12-24개월 | ~10분 읽기)

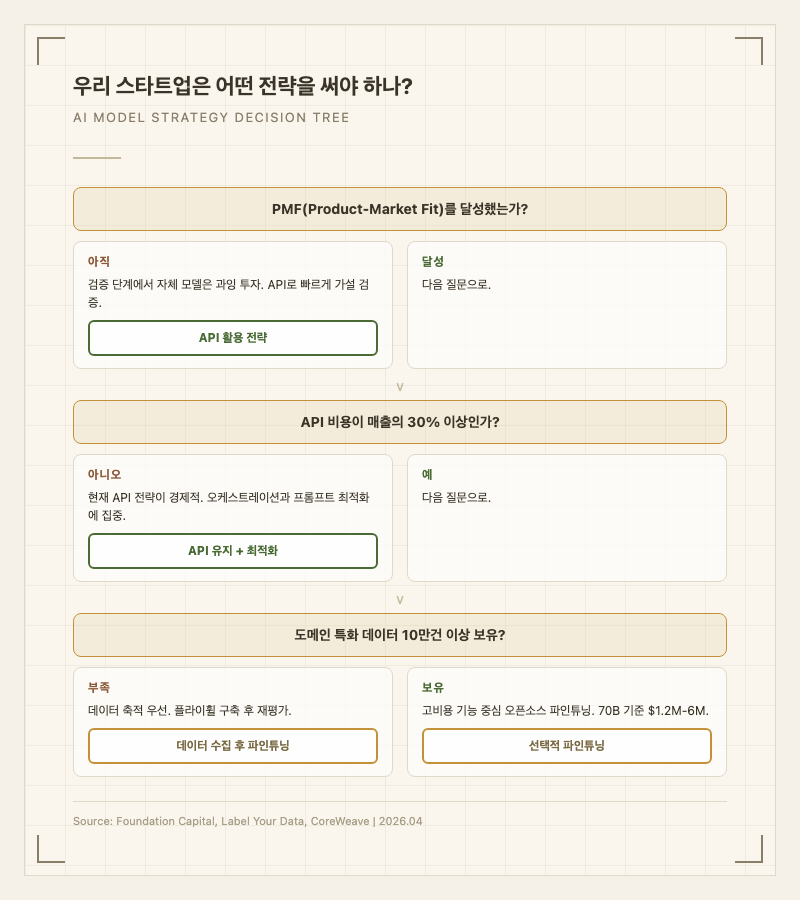

PMF(Product-Market Fit)를 달성한 후 다음 단계다. 사용자 인터랙션 데이터가 쌓이면서 도메인 특화 데이터셋이 형성된다. 이 데이터는 경쟁자가 복제할 수 없는 자산이다.

**파인튜닝은 전체 모델 개발과 완전히 다른 게임이다.** 파인튜닝은 1,000~10,000개의 예시 데이터로도 의미 있는 결과를 얻을 수 있고, 단일 GPU에서도 실행 가능하다. LoRA, QLoRA 같은 효율적 파인튜닝 기법 덕분에 70B 파라미터 모델의 파인튜닝 비용은 5,000~50,000달러 수준이다. 처음부터 같은 규모의 모델을 학습시키려면 120만~600만 달러가 든다. (출처: Label Your Data, cyfuture.ai)

**Vrew의 사례가 이 전략을 잘 보여준다.** AI 영상 편집 도구 Vrew를 만든 보이저X는 음성 인식에 OpenAI Whisper API, 텍스트 생성에 GPT API, 번역에 DeepL/Google Translate API를 활용한다. Vrew가 직접 만든 AI 모델은 하나도 없지만 200만 명 이상의 사용자를 확보했다. Vrew의 경쟁력은 영상 편집이라는 특수한 워크플로우에 여러 API를 자연스럽게 통합한 UX, 그리고 수만 개의 영상 편집 케이스에서 축적한 프롬프트 엔지니어링 노하우에 있다.

체크포인트: 도메인 데이터 10만 건 이상 축적되고, 고빈도/고비용 API 호출 기능이 식별되면 파인튜닝 시점.

### Step

3: 선택적 자체 개발 (24개월+ | ~5분 읽기)

API 비용이 매출의 30% 이상을 차지하고, 도메인 데이터가 충분히 축적된 후에야 자체 모델 개발을 검토한다. 그마저도 범용 LLM이 아니라 특정 기능에 한정된 특화 모델이어야 한다.

**한국 시장의 맥락도 중요하다.** 한국 정부는 '독자 AI 파운데이션 모델' 사업에 2027년까지 5,300억 원을 투입하고, LG AI연구원, SK텔레콤, 업스테이지 등이 참여하고 있다. 하지만 이 프로젝트는 정부 주도의 대규모 투자로 가능한 것이지, 개별 스타트업이 독자적으로 시도할 수 있는 규모가 아니다. 한국 AI 스타트업 생태계는 2026년 3월에도 투자 열기가 지속되고 있으며, 성공적인 한국 AI 스타트업 대부분은 API 활용 + 도메인 특화 전략을 따르고 있다. (출처: 정책브리핑, 아이티인사이트)

## 트러블슈팅: "래퍼" 함정에 빠지지 않는 법

2026년 AI 스타트업 업계에서 가장 큰 경고는 "래퍼(Wrapper) 시대의 종말"이다. Medium의 한 분석에 따르면, 2024년 초에는 프롬프트 작성 능력만으로도 사업이 가능했고, 2025년에는 특화 데이터셋이 시리즈 A를 가능하게 했지만, 2026년에는 "AI 피로감(AI Exhaustion)"이 "AI 과대광고"를 대체하면서 수억 달러 가치로 평가받던 기업들이 접히고 있다. (출처: Medium, Gradienting)

Google VP도 TechCrunch를 통해 두 유형의 AI 스타트업이 살아남기 어렵다고 경고했다. LLM 래퍼(기존 모델 위에 인터페이스만 얹은 회사)와 AI 애그리게이터(여러 모델을 실질적 차별화 없이 조합한 플랫폼)다. 이들은 "마진 축소와 차별화 부재"로 장기적 생존이 위협받고 있다. (출처: TechCrunch, PYMNTS)

### 방어 가능한 해자(Moat)를 만드는 3가지 방법

**1. 독점 데이터 모트(Data Moat)**

프론티어 모델 접근이 보편화되면서, 원시 지능(raw intelligence) 자체는 더 이상 차별화 요소가 아니라 인프라가 되었다. 진짜 해자는 규제된, 고가치의, 산업 특화 데이터셋이다. 공개적으로 크롤링한 데이터가 아니라 서비스 운영 과정에서 자연스럽게 축적되는 독점 데이터가 핵심이다. Stack Overflow 블로그에서도 "기업 AI에는 파운데이션 모델 그 이상이 필요하다"고 지적하며, 기업 내부의 맥락 데이터가 결정적 차이를 만든다고 분석했다. (출처: Stack Overflow Blog)

**2. 깊은 버티컬(Vertical) 전문화**

Foundation Capital은 2026년 전망에서 "성공하는 AI 스타트업은 고객 현장에 엔지니어를 파견해서 문서화되지 않은 업무 규칙을 발견하고, 엣지 케이스를 통해 시스템을 개선한다"고 분석했다. 핀테크, 물류, 헬스케어, 법률 등 특정 산업의 워크플로우를 깊이 이해하고, 그 위에 AI를 통합하는 것이 단순 래퍼와의 결정적 차이다. (출처: Foundation Capital)

**3. 결정 이력(Decision Trace) 축적**

Foundation Capital은 "에이전트가 워크플로우를 실행할 때, 어떤 입력을 수집했고, 어떤 정책을 적용했고, 왜 그런 결정을 내렸는지를 기록하는 결정 이력(Decision Trace)이 시간이 지날수록 복리로 쌓이는 구조적 우위를 만든다"고 분석했다. 이 맥락 그래프(Context Graph)는 경쟁자가 단기간에 복제할 수 없는 자산이다. (출처: Foundation Capital)

### API 의존 리스크와 대응

API-First 전략이 만능은 아니다. 실제 리스크와 대응 방안을 정리한다.

**공급업체 리스크**: Salesforce, ServiceNow 같은 대형 플랫폼이 API 접근을 제한하고 자체 AI 어시스턴트를 밀어붙이는 추세다. Foundation Capital은 "서드파티 데이터 접근에 의존하는 스타트업은 전략적 리스크에 직면한다"고 경고했다. 대응: 멀티 프로바이더 폴백 + 핵심 기능의 점진적 내재화.

**데이터 프라이버시**: 민감 데이터가 외부 API로 전송된다. 대응: 민감 데이터 처리에 한해 로컬 오픈소스 모델(Llama 4, DeepSeek V3 등) 병행 운영.

**비용 스케일**: 사용량이 늘면 API 비용이 선형 증가한다. 대응: 캐싱, 배치 처리, 그리고 비용 임계점 도달 시 고빈도 기능부터 파인튜닝으로 전환.

## 더 알아보기

- MIT Technology Review는 "AI 모델 커스터마이제이션으로의 전환은 아키텍처적 필수사항"이라고 분석하며, 하이브리드 접근법이 2026년의 주류가 되고 있다고 진단했다

- CoreWeave는 사전학습 vs 파인튜닝 vs RAG의 비교 가이드에서, 대부분의 비즈니스 사용 사례에서 RAG + 파인튜닝 조합이 최적이라고 결론 내렸다

- 2026년 VC들은 AI 스타트업에 전체 VC 펀딩의 33%를 투자하고 있으며, "모델 중심"이 아닌 "모트(Moat) 중심" 평가 기준으로 전환 중이다

```references

https://www.pymnts.com/artificial-intelligence-2/2025/ai-cheat-sheet-large-language-foundation-model-training-costs/

https://foundationcapital.com/ideas/where-ai-is-headed-in-2026

https://techcrunch.com/2026/02/21/google-vp-warns-that-two-types-of-ai-startups-may-not-survive/

https://medium.com/write-a-catalyst/the-great-ai-collapse-of-2026-why-most-startups-are-failing-and-how-to-build-an-unbreakable-moat-94b81d57df72

https://techstrong.ai/agentic-ai/early-critic-of-deepseek-says-model-cost-was-1-6-billion-not-5-6-million/

https://stackoverflow.blog/2026/03/12/enterprise-ai-needs-more-than-foundation-models/

https://www.technologyreview.com/2026/03/31/1134762/shifting-to-ai-model-customization-is-an-architectural-imperative/

https://labelyourdata.com/articles/llm-fine-tuning/pre-training-vs-fine-tuning

https://www.coherentsolutions.com/insights/ai-development-cost-estimation-pricing-structure-roi

https://www.azilen.com/blog/ai-development-cost/

https://iexchange.substack.com/p/the-2026-vc-playbook-how-investment

https://www.itinsight.kr/news/434900

https://www.korea.kr/news/policyNewsView.do?newsId=148956404

```