Agentic Workflow

쉽게 이해하기

일반적인 AI 채팅은 '질문 하나, 답변 하나'로 끝납니다. 마치 식당에서 "오늘 뭐 먹을까?"라고 물었을 때 "파스타요"라고 한마디만 하는 것과 같습니다. 반면 Agentic Workflow는 AI가 직접 냉장고를 열어보고, 재료를 확인하고, 레시피를 검색하고, 부족한 재료는 장보기 목록에 추가하고, 조리 순서를 정해서 실제로 요리를 완성하는 것까지 해내는 방식입니다. 핵심은 AI가 단순한 답변 생성기가 아니라, 목표를 향해 스스로 계획하고, 도구를 사용하고, 결과를 검증하며 반복적으로 작업하는 자율적 실행자가 된다는 점입니다.

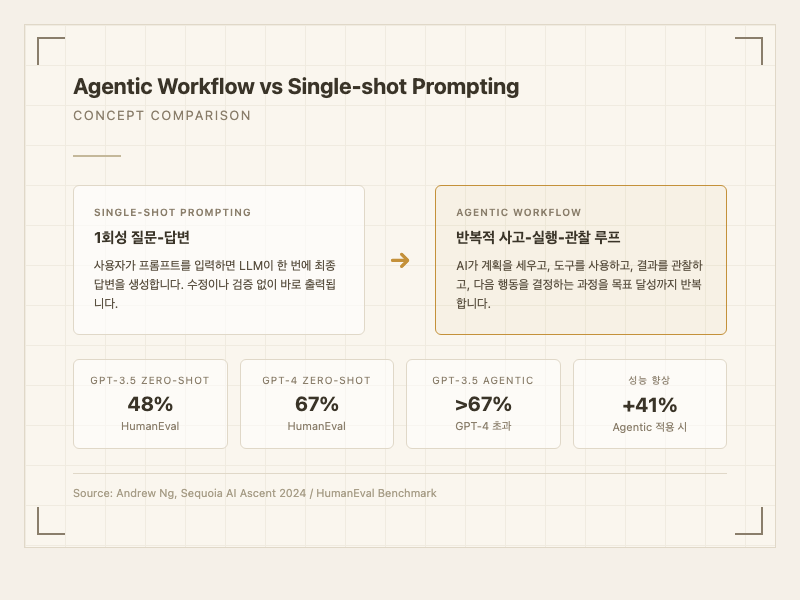

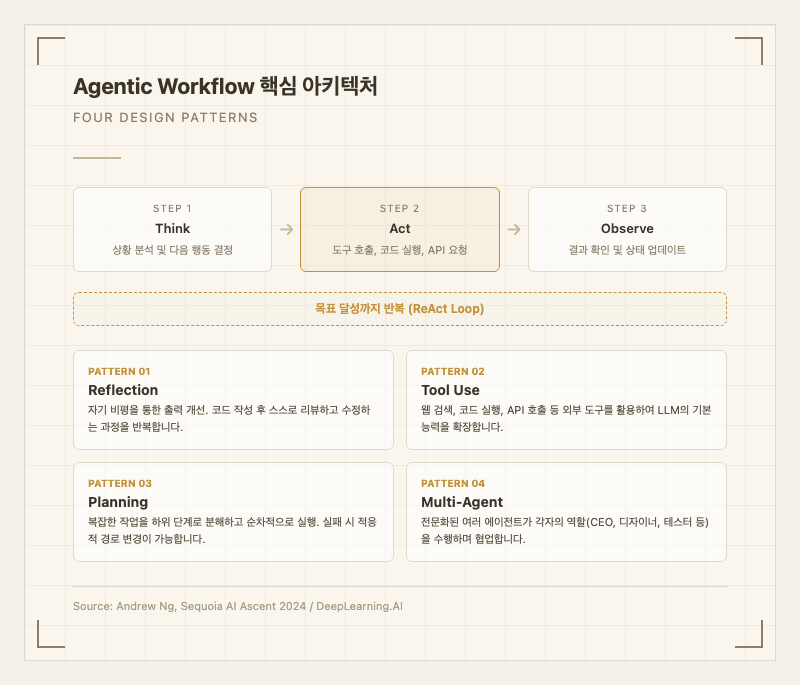

기존의 LLM 활용 방식(Single-shot Prompting)에서는 사용자가 프롬프트를 입력하면 모델이 한 번에 최종 결과를 생성합니다. 중간에 외부 정보를 확인하거나, 자신의 출력을 검토하거나, 실패 시 다른 방법을 시도하는 것이 불가능합니다. Agentic Workflow는 이 한계를 근본적으로 극복합니다. AI가 "생각(Think) - 행동(Act) - 관찰(Observe)"의 루프를 반복하면서, 각 단계의 결과를 바탕으로 다음 행동을 결정합니다. 이 과정에서 웹 검색, 코드 실행, API 호출, 파일 조작 등 다양한 도구를 자율적으로 사용합니다.

대표적인 실제 서비스로는 @Claude Code가 있습니다. 사용자가 "이 버그를 고쳐줘"라고 요청하면, Claude Code는 관련 파일을 읽고, 코드를 분석하고, 수정 사항을 작성하고, 테스트를 실행하고, 결과를 보고하는 전체 과정을 자율적으로 수행합니다. @Cursor 역시 코드 편집 과정에서 에이전틱 워크플로우를 활용하며, @GitHub Copilot도 에이전트 모드를 통해 멀티스텝 코딩 작업을 지원합니다.

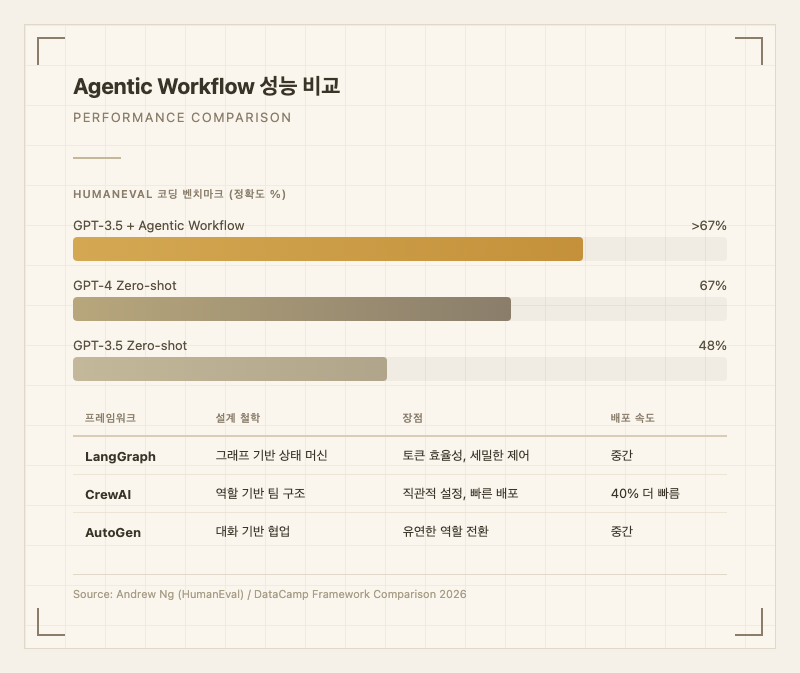

Andrew Ng의 발표에 따르면, GPT-3.5에 Agentic Workflow를 적용했을 때 HumanEval 코딩 벤치마크에서 GPT-4의 Zero-shot 성능(67%)을 초과하는 결과를 보였습니다1. 더 약한 모델이라도 반복적으로 사고하고, 검증하고, 수정하는 워크플로우를 적용하면 더 강한 모델의 1회성 출력보다 나은 결과를 만들 수 있다는 것입니다. 2026년 현재 42%의 기업이 에이전틱 AI를 프로덕션에 배포했으며, 171% 이상의 ROI를 보고한 조직들의 공통점은 잘 정의된 유스케이스에서 시작했다는 것입니다2.

기술 심층 분석

선수학습: 이 내용을 이해하려면 ReAct (Reasoning + Acting)을 먼저 읽으면 좋습니다.

핵심 아키텍처

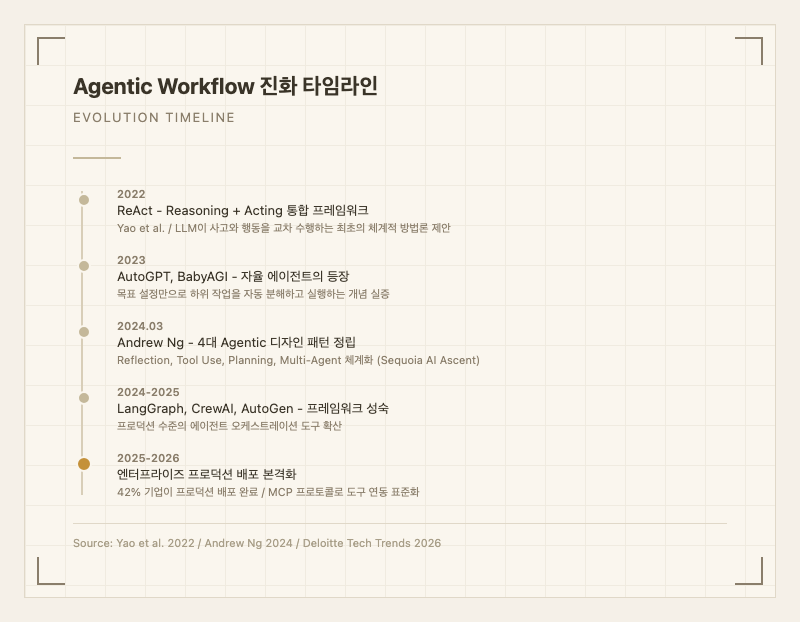

Agentic Workflow의 이론적 토대는 2022년 Yao et al.이 제안한 ReAct 패턴입니다. LLM이 추론(Reasoning)과 행동(Acting)을 교차 수행하며, 외부 환경과 상호작용하는 루프를 형성합니다.

Andrew Ng는 2024년 Sequoia AI Ascent에서 이 아키텍처를 4가지 디자인 패턴으로 체계화했습니다3:

1. Reflection (자기 성찰): LLM이 자신의 출력을 비평하고 개선하는 반복 과정입니다. 코드를 작성한 후 스스로 리뷰하고, 버그를 찾아 수정하는 식입니다. 가장 구현이 단순하면서도 효과가 큰 패턴입니다.

2. Tool Use (도구 사용): 웹 검색, 코드 실행, 데이터베이스 조회, API 호출 등 외부 도구를 LLM이 자율적으로 선택하고 실행합니다. Model Context Protocol(MCP)과 같은 표준이 등장하면서 도구 연동이 크게 간소화되고 있습니다.

3. Planning (계획 수립): 복잡한 작업을 실행 가능한 하위 단계로 분해합니다. 각 단계의 성공/실패에 따라 계획을 동적으로 수정할 수 있으며, 이 패턴의 하위 방법론으로 Plan Mode Workflow가 있습니다.

4. Multi-Agent Collaboration (멀티 에이전트 협업): 전문화된 여러 에이전트가 각자의 역할을 수행하며 협업합니다. ChatDev에서는 CEO, 디자이너, 프로그래머, 테스터 역할의 에이전트가 소프트웨어를 공동 개발합니다.

python

# 에이전트 루프 핵심 의사코드

async def agent_loop(task, tools, max_steps=20):

messages = [{"role": "user", "content": task}]

for step in range(max_steps):

response = await llm.complete(messages, tools=tools)

if response.stop_reason == "end_turn":

return response.content

if response.stop_reason == "tool_use":

results = [await execute(tc) for tc in response.tool_calls]

messages.append({"role": "assistant", "content": response.content})

messages.append({"role": "tool", "content": results})

return "max steps reached"

멀티 에이전트 아키텍처 구조:

[오케스트레이터] 강력한 모델 (리더)

|

+-- [서브에이전트 1] 효율적 모델 -> 백엔드 구현

+-- [서브에이전트 2] 효율적 모델 -> 프론트엔드 구현

+-- [서브에이전트 3] 효율적 모델 -> 테스트 작성

하위 방법론인 Agentic Research Loop은 연구/조사 작업에 특화된 에이전틱 패턴이며, Auto Research는 자동화된 연구 수행을 위한 변형입니다.

성능 및 비교

| 방식 | HumanEval 정확도 | 특징 | 출처 |

|---|---|---|---|

| GPT-3.5 Zero-shot | 48% | 1회 생성 | Andrew Ng, Sequoia AI Ascent 2024 |

| GPT-4 Zero-shot | 67% | 1회 생성 | Andrew Ng, Sequoia AI Ascent 2024 |

| GPT-3.5 + Agentic | >67% | 반복 사고/실행/검증 | Andrew Ng, Sequoia AI Ascent 2024 |

| Agentic 방식 전반 | +41% 향상 | 기존 대비 | Synergy Technical, 2025 |

| 에이전트 유형 | 자율성 | 신뢰성 | 적합한 작업 |

|---|---|---|---|

| Single-turn | 없음 | 매우 높음 | Q&A, 번역 |

| Multi-turn | 낮음 | 높음 | 코드 생성, 문서 작성 |

| Single-agent loop | 중간 | 중간 | 파일 조작, API 호출 |

| Multi-agent | 높음 | 낮음-중간 | 복잡한 소프트웨어 개발 |

핵심 인사이트: Agentic Workflow를 적용하면 약한 모델(GPT-3.5)이 강한 모델(GPT-4)의 1회성 출력을 초과할 수 있습니다. 다만 이는 추가적인 토큰 소비와 지연 시간을 수반합니다.

프레임워크 비교 (2026년 기준):

| 프레임워크 | 설계 철학 | 강점 | Time-to-Production |

|---|---|---|---|

| LangGraph | 그래프 기반 상태 머신 | 토큰 효율성, 세밀한 제어, Human-in-the-loop | 중간 (DataCamp, 2026) |

| CrewAI | 역할 기반 팀 구조 | 직관적 설정, 빠른 배포 | 40% 더 빠름 (DataCamp, 2026) |

| AutoGen | 대화 기반 협업 | 유연한 역할 전환, No-code Studio | 중간 (DataCamp, 2026) |

장점과 한계

장점:

- 약한 모델로 강한 결과: Agentic Workflow 적용 시 GPT-3.5가 GPT-4 Zero-shot을 초과하는 성능을 달성 (HumanEval 기준, Andrew Ng 2024)

- 복잡한 멀티스텝 작업 자동화: 파일 읽기 - 코드 수정 - 테스트 실행 - 결과 보고까지 일련의 과정을 사람 개입 없이 수행

- 자기 교정 능력: Reflection 패턴을 통해 오류를 스스로 발견하고 수정. 단순 재생성보다 체계적인 품질 개선

- 24/7 비동기 실행: 시간이 걸리는 작업(코드 리팩토링, 데이터 처리 등)을 백그라운드에서 자율 실행

- 도구 생태계 확장: MCP 프로토콜 등장으로 새로운 도구 연동이 표준화되어 통합 비용이 크게 감소

한계:

- 오류 전파(Error Cascading): 초기 단계의 실수가 이후 단계에 누적됩니다. 해결 방향: 각 단계마다 검증 체크포인트 설정, 중요 단계에서 Human-in-the-loop 적용

- 비용 증가: 여러 단계 = 많은 토큰 소비. 복잡한 작업에서 Single-shot 대비 5-10배 비용 발생 가능. 해결 방향: 오케스트레이터에 강한 모델, 실행자에 효율적 모델 사용

- 비결정성(Non-determinism): 같은 입력에 다른 실행 경로와 결과. 디버깅과 재현이 어려움. 해결 방향: 실행 트레이스 로깅, 구조화된 출력 강제

- 레이턴시: 반복적 사고-실행 루프로 인해 수분에서 수시간 소요. 실시간 응답이 필요한 시나리오에 부적합. 대안: 단순 작업은 Single-shot으로 분리

- 보안 위험: 프롬프트 인젝션, 권한 남용 가능성. 에이전트가 의도치 않은 파일 삭제나 데이터 유출을 실행할 위험. 해결 방향: 최소 권한 원칙, 샌드박스 환경 적용

치명적 시나리오: 실시간 트레이딩, 의료 진단 등 즉각적 응답이 필요하고 오류 비용이 극히 높은 영역에서는 Full Agentic 방식이 부적합합니다.

실무 적용 가이드

적합한 시나리오:

- 코드 리뷰, 리팩토링, 버그 수정 등 멀티스텝 개발 작업

- 데이터 수집 - 분석 - 보고서 생성 파이프라인

- 복잡한 문서 작성 (조사 - 초안 - 검토 - 수정 반복)

- 비동기 실행이 허용되는 백오피스 자동화

부적합한 시나리오:

- 실시간 응답이 필요한 챗봇 (레이턴시 제약)

- 단순 Q&A, 번역 등 1회성 작업 (오버엔지니어링)

- 오류 비용이 극히 높고 즉각 판단이 필요한 영역 (의료, 금융 트레이딩)

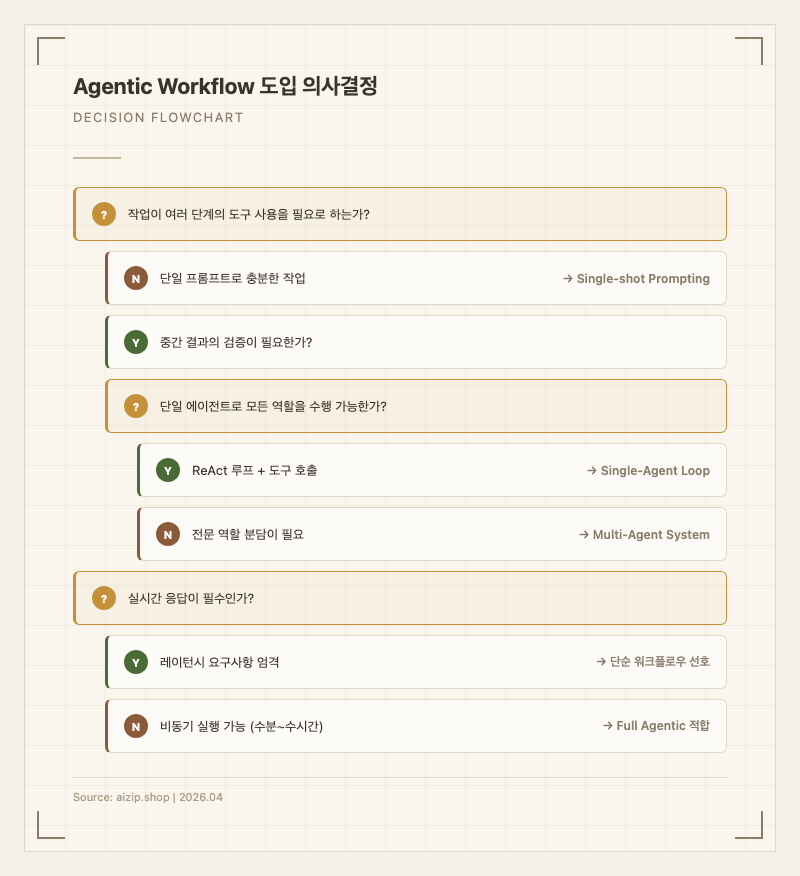

도입 판단 기준:

- 작업이 3단계 이상의 도구 사용을 필요로 하는가?

- 중간 결과의 검증/수정이 품질에 중요한 영향을 미치는가?

- 수분~수시간의 실행 시간이 허용되는가?

- 위 3가지에 모두 "예"라면 Agentic Workflow 도입이 적합합니다.

프레임워크 선택 기준:

- 상태 관리가 복잡하고 세밀한 제어가 필요하면 LangGraph

- 역할 기반 팀 구조로 빠르게 배포하려면 CrewAI

- 대화형 에이전트 간 자연스러운 협업이 필요하면 AutoGen

이 방법론을 활용하는 서비스: @Claude Code, @Cursor, @GitHub Copilot