Agentic Research Loop

Agentic Workflow

쉽게 이해하기

대학원생이 졸업 논문을 쓸 때를 생각해 보자. 도서관에서 논문 하나를 읽고, 그 논문이 인용한 다른 논문을 찾아 읽고, 거기서 또 새로운 키워드를 발견해 추가로 검색하고, 서로 상충하는 주장이 나오면 제3의 소스를 찾아 교차 검증한다. 이 과정을 "충분히 알았다"고 느낄 때까지 반복한다. Agentic Research Loop는 AI가 이 과정을 자율적으로 수행하는 방법론이다. 사람이 중간에 개입하지 않아도, AI 에이전트가 스스로 "아직 부족한 정보가 무엇인지" 판단하고 추가 검색을 반복한다.

기존 방식과의 차이는 명확하다. 일반 검색 엔진은 키워드를 넣으면 관련 링크 10개를 보여주고 끝이다. RAG (Retrieval-Augmented Generation)는 한 발 더 나아가 검색 결과를 읽고 답변을 생성하지만, 보통 1-3회 검색으로 끝난다. 반면 Agentic Research Loop는 10회에서 100회 이상 반복 검색하며, 매 단계마다 "지금까지 수집한 정보에서 빠진 부분이 무엇인가?"를 자기 평가(Gap Analysis)한 뒤 새로운 검색 쿼리를 스스로 생성한다. 검색과 추론이 분리된 순차 단계가 아니라, 서로 영향을 주고받는 동적 피드백 루프로 작동한다.

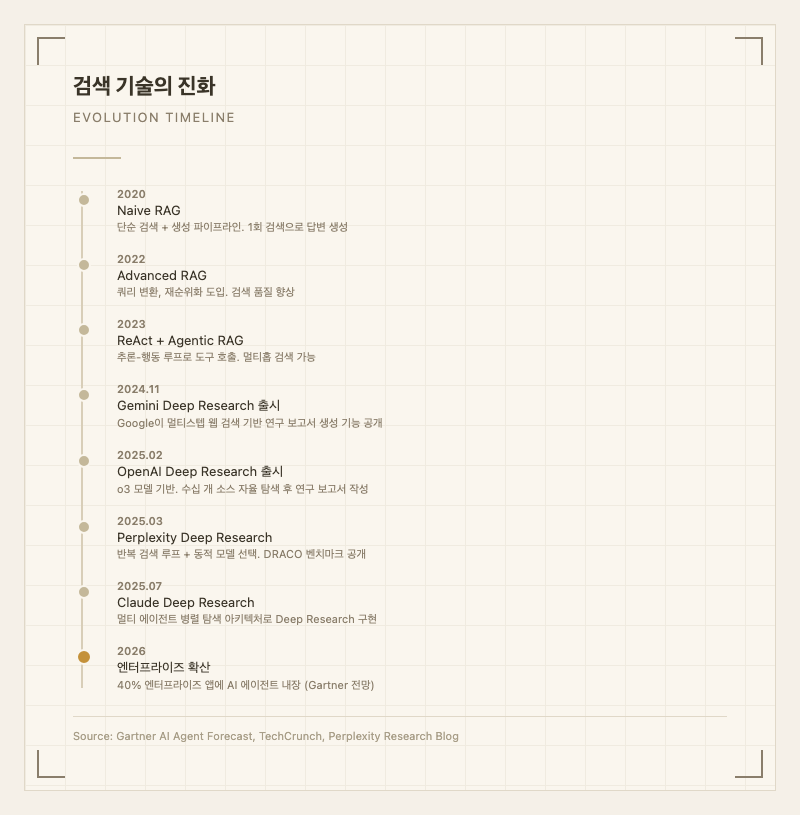

실제 서비스에서 이 방법론은 "Deep Research"라는 이름으로 상용화되었다. @ChatGPT의 Deep Research는 2025년 2월 o3 모델 기반으로 출시되어 수십 개 소스를 자율 탐색한 뒤 연구 보고서를 생성한다. @Gemini의 Deep Research는 2024년 11월에 먼저 출시되어 멀티스텝 웹 검색으로 논문 수준 리포트를 작성한다. @Perplexity는 반복 검색 루프에 동적 모델 선택을 결합했으며, @Claude는 멀티 에이전트 병렬 탐색 아키텍처로 Deep Research를 구현했다.

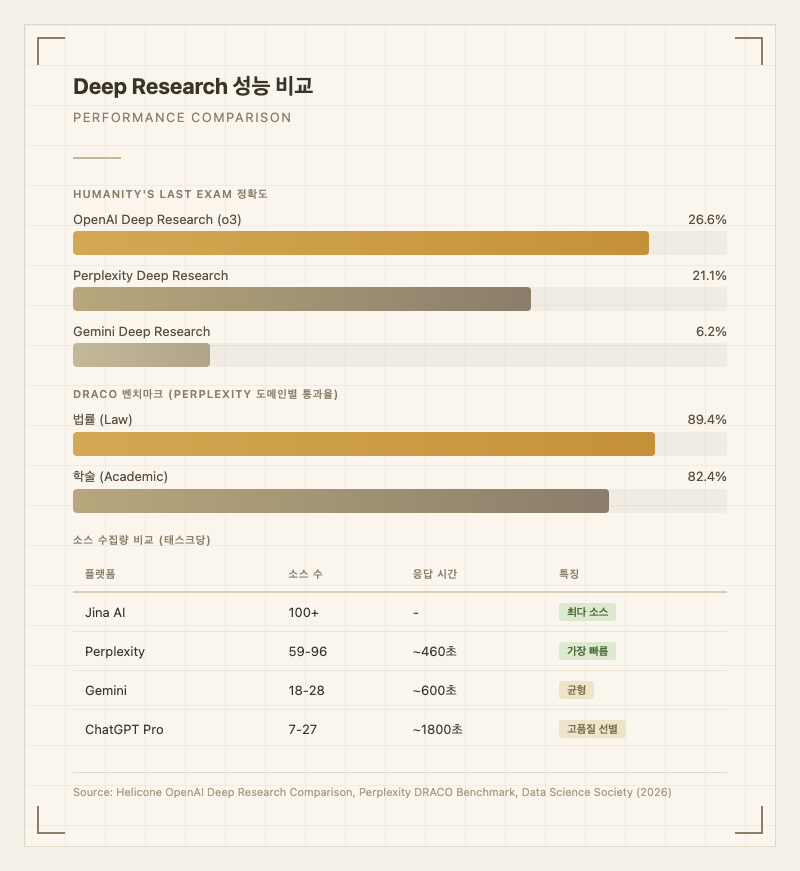

정량적으로 보면, Humanity's Last Exam 벤치마크에서 OpenAI Deep Research(o3)가 26.6%, Perplexity Deep Research가 21.1%의 정확도를 기록했다(Helicone 비교 분석, 2025). 이 수치는 절대값으로는 낮아 보이지만, 해당 벤치마크가 전문가도 풀기 어려운 극난이도 문제로 구성되어 있다는 점을 감안하면, Agentic Research Loop가 단순 검색 대비 압도적인 심층 분석 능력을 보여주는 것이다.

기술 심층 분석

선수학습: 이 내용을 이해하려면 Agentic Workflow와 ReAct (Reasoning + Acting)를 먼저 읽으면 좋습니다.

핵심 아키텍처

Agentic Research Loop의 핵심은 검색-분석-평가-재검색 사이클의 자율 반복이다. 전통적 RAG가 "Retrieve -> Generate"의 단방향 파이프라인이라면, 이 방법론은 추론이 검색 쿼리를 정제하고, 검색 결과가 다시 추론을 업데이트하는 양방향 피드백 루프를 형성한다.

[Agentic Research Loop - 실행 흐름]

사용자 질의: "양자 컴퓨팅이 암호화에 미치는 영향 분석"

|

v

1. 질의 분해 (Query Decomposition)

Q1: "양자 컴퓨팅 현재 기술 수준"

Q2: "Shor 알고리즘 RSA 위협 시나리오"

Q3: "포스트 양자 암호화 표준화 진행 상황"

Q4: "양자 컴퓨팅 상용화 타임라인"

|

v

2. 병렬 검색 실행 (Parallel Search)

search(Q1) --+

search(Q2) --+-- 결과 통합 및 분석

search(Q3) --+

search(Q4) --+

|

v

3. 갭 분석 (Gap Analysis)

"수집된 정보 평가:

- Q1: 충분

- Q2: 구체적 키 길이별 위협 수치 부족

- Q3: NIST 최종 표준 발표 날짜 불확실

- Q4: 충분"

-> 보충 쿼리 생성: Q2', Q3'

|

v

4. 보충 검색 (Refinement Search)

search(Q2': "RSA 2048 양자 해독 소요 시간 추정치")

search(Q3': "NIST PQC 표준 2025 최종 발표")

|

v

5. 충분성 판단 -> 최종 보고서 합성

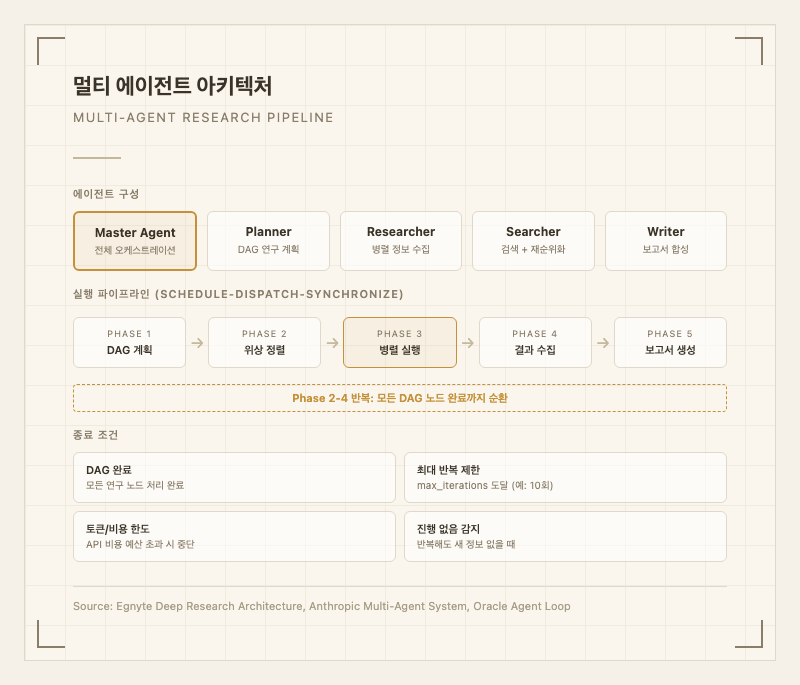

상용 구현체들은 이 기본 루프를 멀티 에이전트 아키텍처로 확장한다. Egnyte의 Deep Research 아키텍처 분석에 따르면, 대표적인 구성은 5개의 전문화된 에이전트가 협업하는 Orchestrator-Worker 패턴이다:

- Master Agent: 전체 워크플로우를 오케스트레이션. Schedule-Dispatch-Synchronize 사이클 관리

- Planner Agent: 사용자 질의를 분석해 DAG(Directed Acyclic Graph) 형태의 연구 계획 수립

- Researcher Agent: 병렬로 인스턴스화되어 각 서브 질문에 대한 정보 수집. 갭 분석 수행

- Searcher Agent: 실제 웹 검색 실행 및 cross-encoder 알고리즘으로 결과 재순위화

- Writer Agent: 수집된 정보를 주제별로 클러스터링하여 구조화된 보고서 합성

실행 흐름은 DAG의 위상 정렬(Topological Sort)을 따른다. Master Agent가 의존성이 충족된 질문 노드를 식별하고, 해당 노드들에 대해 Researcher Agent를 병렬로 디스패치한다. 모든 결과가 수집되면 다음 레벨의 노드로 진행하며, 모든 DAG 노드가 완료될 때까지 이 사이클을 반복한다.

python

class AgenticResearchLoop:

def __init__(self, llm, search_tool, max_iterations=10):

self.llm = llm

self.search = search_tool

self.knowledge_base = {}

self.max_iter = max_iterations

async def research(self, topic):

plan = await self.llm.decompose_query(topic)

queries = plan.sub_questions

for iteration in range(self.max_iter):

results = await asyncio.gather(*[

self.search.query(q) for q in queries

])

for query, result in zip(queries, results):

self.knowledge_base[query] = result

gaps = await self.llm.analyze_gaps(

topic=topic,

collected=self.knowledge_base

)

if gaps.is_sufficient:

break

queries = gaps.follow_up_queries

return await self.llm.synthesize_report(

topic, self.knowledge_base

)

종료 조건은 여러 레이어로 구성된다:

- 목표 달성: 갭 분석 결과 모든 서브 질문에 충분한 답이 확보됨

- 최대 반복 제한:

max_iterations도달 (보통 5-15회) - 토큰/비용 한도: API 호출 비용이 설정된 예산 초과

- 진행 없음 감지: 연속 2-3회 반복에서 새로운 정보가 추가되지 않음

성능 및 비교

| 접근 방식 | 검색 깊이 | 응답 시간 | 소스 수 | 적합 용도 |

|---|---|---|---|---|

| 키워드 검색 | 1회 | 초 단위 | 10개 링크 | 빠른 팩트 체크 |

| Naive RAG | 1-3회 | 수 초 | 3-5개 | 문서 기반 Q&A |

| Advanced RAG | 3-5회 | 5-15초 | 5-10개 | 정밀 검색 Q&A |

| Agentic RAG | 5-15회 | 30초-2분 | 10-30개 | 멀티홉 질의 |

| Agentic Research Loop | 10-100회 | 5-30분 | 50-100+개 | 심층 연구 보고서 |

(출처: Firecrawl Deep Research Guide, Helicone 비교 분석)

Humanity's Last Exam 벤치마크에서의 정확도 비교 (Helicone, 2025):

| 시스템 | 정확도 | 비고 |

|---|---|---|

| OpenAI Deep Research (o3) | 26.6% | 가장 높은 정확도, 응답 시간 ~30분 (Helicone) |

| Perplexity Deep Research | 21.1% | 응답 시간 ~8분으로 가장 빠름 (Helicone) |

| Gemini Deep Research | 6.2% | 멀티모달 통합 강점 (Helicone) |

Perplexity의 DRACO 벤치마크(100개 태스크, 10개 도메인)에서는 법률 도메인 89.4%, 학술 도메인 82.4%의 통과율을 기록했다(Perplexity Research Blog, 2025). 이 수치는 Deep Research가 정보의 포맷이 아닌 사실 정확성과 분석 완전성에서 차별화됨을 보여준다.

실무적 의미: Agentic Research Loop는 "빠른 답변"이 아니라 "정확하고 포괄적인 보고서"가 필요한 시나리오에서 가치가 있다. 응답 시간이 5-30분으로 길지만, 수십-수백 개 소스를 교차 검증한 결과물의 품질은 단순 RAG와 비교할 수 없다.

장점과 한계

장점:

- 심층 정보 발굴: 단순 검색으로는 찾기 어려운 2-3차 연결 정보까지 발굴. 갭 분석이 "모르는 것을 모르는" 상태를 해소

- 교차 검증 내장: 다중 소스에서 같은 주장이 확인될 때만 채택하므로 단일 소스 편향 감소. Perplexity는 태스크당 59-96개 소스를 수집 (DRACO 벤치마크)

- 구조화된 보고서: 원시 검색 결과가 아닌, 주제별로 정리되고 출처가 명시된 분석 보고서를 자동 생성

- 자율 실행: 사용자가 중간에 개입하지 않아도 연구 계획 수립부터 보고서 작성까지 완전 자동화

- 확장 가능한 아키텍처: 멀티 에이전트 구조로 서브 질문을 병렬 처리하여 복잡한 주제도 체계적으로 분해

한계:

- 높은 비용과 지연: 수십-수백 회의 LLM 호출과 웹 검색이 필요하여 비용이 높고 응답 시간이 5-30분. 해결 방향: 캐싱, 검색 결과 재사용, 비용 한도 설정

- 환각 누적 위험: 초기 반복에서 발생한 잘못된 정보가 후속 검색 쿼리에 영향을 미쳐 오류가 증폭될 수 있음. GPT-4급 모델도 강제 답변 시 20-30% 팩트 오류 발생 (Lakera, 2026). 해결 방향: 불확실성 인지 RLHF, 신뢰도 임계값 설정

- 소스 편향: 웹에서 접근 가능한 정보에 한정되므로, 유료 논문이나 사내 문서 등 접근 불가 소스는 누락. 해결 방향: 기업 내부 문서 통합, API 기반 학술 DB 연동

- 평가 어려움: 생성된 보고서의 품질을 객관적으로 측정하기 어려움. DRACO 같은 벤치마크가 등장했지만 아직 표준화되지 않음. 해결 방향: 도메인별 전문가 평가 체계 구축

- 오류 전파: 연구 계획(DAG)이 잘못 수립되면 이후 모든 단계에 부정적 영향. 해결 방향: 계획 단계에서의 사용자 확인(OpenAI 방식), Reviewer Agent 도입

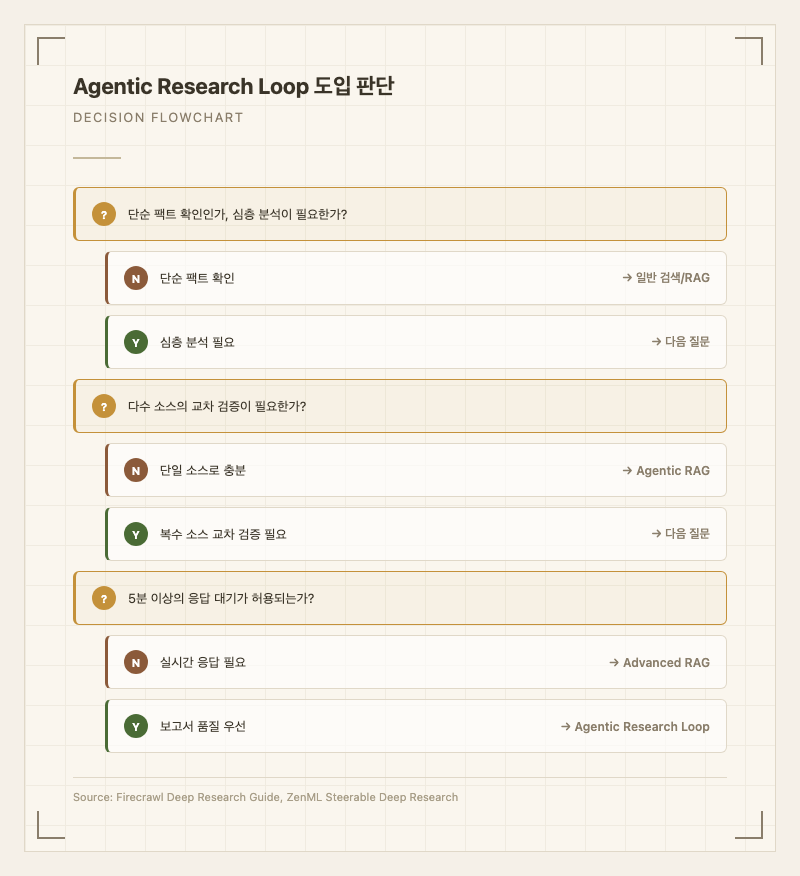

실무 적용 가이드

적합한 시나리오:

- 경쟁사 분석, 시장 조사 등 다수 소스의 종합이 필요한 비즈니스 리서치

- 학술 문헌 리뷰, 기술 동향 분석

- 법률/의료/금융 등 정확성이 중요한 도메인의 심층 조사

- 의사결정 지원을 위한 포괄적 보고서 생성

부적합한 시나리오:

- 실시간 응답이 필요한 챗봇이나 고객 서비스 (응답 시간 5분 이상)

- 단순 팩트 확인 ("서울 인구는?")

- 비용에 민감한 대량 처리 파이프라인

도입 판단 기준:

- 보고서 품질이 응답 속도보다 중요한가? -> Yes면 Agentic Research Loop

- 검증해야 할 소스가 10개 이상인가? -> Yes면 Agentic Research Loop

- API 호출 비용 $0.25-2.00/건이 허용 가능한가? -> No면 Advanced RAG 고려

현재 이 방법론을 사용하는 서비스:

- @ChatGPT Deep Research - o3 모델 기반, 가장 높은 정확도

- @Gemini Deep Research - 멀티모달 통합, Google 생태계 연동

- @Perplexity Deep Research - 가장 빠른 응답, DRACO 벤치마크 공개

- @Claude - 멀티 에이전트 병렬 탐색 아키텍처