Command R+ (08-2024)

CohereLLM자연어 처리컴퓨터 비전오디오 처리128K 토큰

2024년 8월 30일CC-BY-NC + Cohere SaaS Agreement

한줄 소개

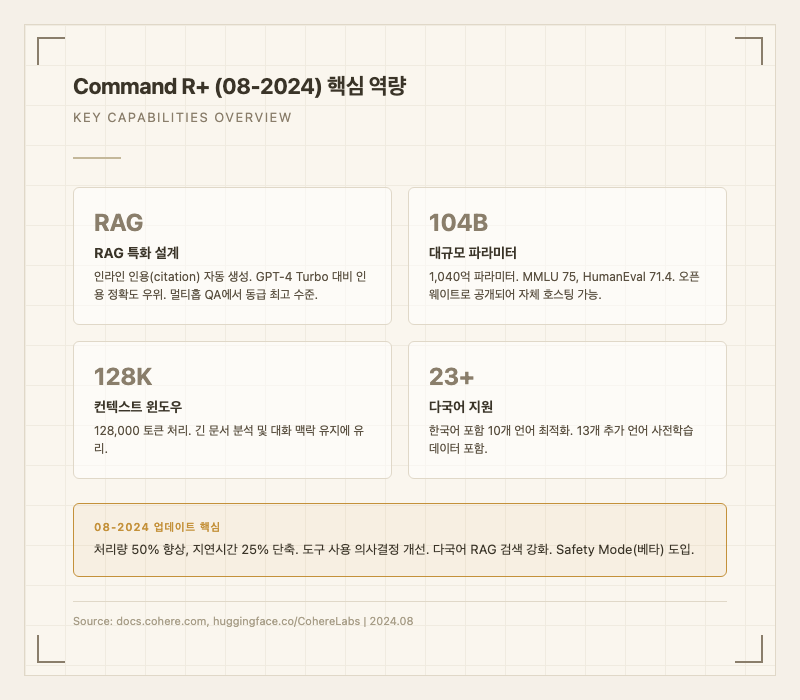

Command R+ (08-2024)는 Cohere가 만든 1,040억 파라미터 규모의 대형 언어 모델로, 기업용 RAG(검색 증강 생성)와 도구 사용(tool use)에 특화된 모델이다. 2024년 8월에 기존 Command R+의 성능 개선 버전으로 출시되었으며, 처리량 50% 향상과 지연시간 25% 단축을 달성하면서도 동일한 하드웨어 요구 사항을 유지한 것이 핵심 업데이트 내용이다.

주요 특징

Command R+가 다른 LLM과 가장 뚜렷하게 차별화되는 지점은 RAG 파이프라인에 대한 네이티브 최적화다. 일반적인 LLM이 검색된 문서를 단순히 컨텍스트에 넣고 응답하는 방식이라면, Command R+는 검색된 문서에서 정보를 추출할 때 인라인 인용(citation)을 자동으로 생성한다. Cohere 공식 평가에 따르면 인용 정확도(citation fidelity)에서 GPT-4 Turbo를 상회한다 (출처: Cohere 공식 블로그). 이 기능은 기업 환경에서 AI 응답의 신뢰성과 추적 가능성을 높이는 데 실질적인 가치가 있다.

두 번째 차별점은 멀티스텝 도구 사용이다. 제로샷(zero-shot) 방식으로 새로운 도구를 학습할 수 있어, 함수 이름과 인자 스키마만 제공하면 복잡한 에이전트 워크플로우를 구성할 수 있다. Cohere 공식 벤치마크에서 도구 사용 정확도가 GPT-4 Turbo를 넘었다고 발표했다 (출처: Cohere 공식 블로그).

세 번째는 다국어 지원 폭이다. 한국어를 포함한 10개 언어에 최적화되어 있고, 러시아어, 폴란드어, 터키어 등 13개 언어의 사전학습 데이터를 추가로 포함한다. 총 23개 이상의 언어를 커버하므로 글로벌 기업 환경에서 유용하다.

08-2024 업데이트에서 추가된 Safety Mode(베타)는 모델 응답의 안전성을 제어하는 기능으로, 기업 규정에 맞는 필터링이 가능하다. 다만 아직 베타 단계라는 점은 참고할 필요가 있다.

실사용자들 사이에서는 RAG 파이프라인에 쓸 때 "인용이 자동으로 달리는 게 생각보다 편하다"는 반응이 많지만, 범용 대화나 코딩 작업에서는 GPT-4o나 Claude 대비 체감 성능이 떨어진다는 의견이 지배적이다.

할 수 있는 것

Command R+가 가장 잘하는 영역은 명확하다. 기업 내부 문서를 검색하고 답변을 생성하는 RAG 워크플로우다. Cohere의 Embed(임베딩)와 Rerank(재순위화) 모델과 조합하면 문서 검색부터 답변 생성, 인용 첨부까지 하나의 플랫폼에서 엔드투엔드로 처리할 수 있다.

도구 사용 기반의 에이전트 구축도 주요 유스케이스다. 예를 들어 고객 문의를 받아 주문 조회 API를 호출하고, 결과를 요약해서 답변하는 멀티스텝 워크플로우를 구성할 수 있다. 공식 문서에서도 이 사용 패턴을 강조한다.

멀티홉 QA(여러 문서를 교차 참조하는 질의응답)에서는 동일 가격대 모델 중 최고 수준의 성능을 보인다 (출처: Cohere 공식 블로그). 실사용자 후기를 보면 "미디어 트랜스크립트 위에 RAG를 돌릴 때 Command R+가 제일 낫다"는 평가가 있다.

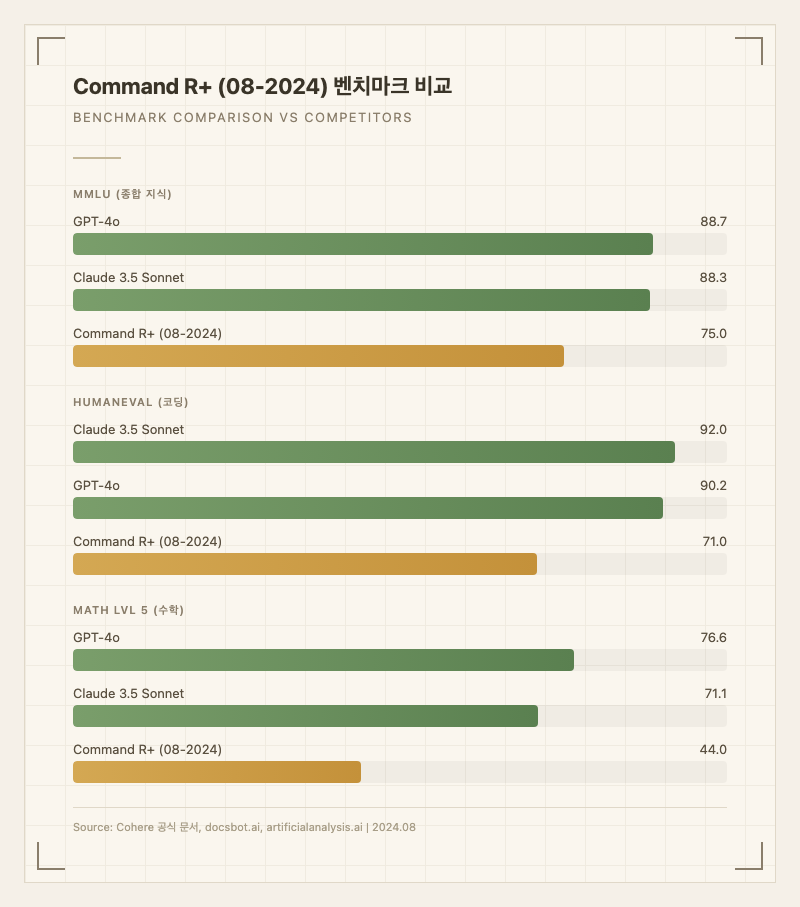

반면에 못하는 것도 분명하다. 이미지 입력을 지원하지 않아 멀티모달 작업은 불가능하다. 코딩 작업에서 HumanEval 71로 GPT-4o(90.2)나 Claude 3.5 Sonnet(92.0)에 크게 뒤지고, 수학 문제 풀이(MATH 44)도 경쟁 모델 대비 약하다. "RAG 말고 다른 걸 시키면 체감이 확 떨어진다"는 것이 실사용자들의 공통 의견이다.

성능

벤치마크 수치를 보면, Command R+의 위치가 명확하다. MMLU 75, HumanEval 71, MATH Lvl 5 44, GSM8K 66.9로, 범용 성능에서는 GPT-4o(MMLU 88.7)나 Claude 3.5 Sonnet(MMLU 88.3) 대비 상당한 격차가 있다 (출처: Cohere 공식 문서, docsbot.ai).

| 벤치마크 | Command R+ (08-2024) | GPT-4o | Claude 3.5 Sonnet |

|---|---|---|---|

| MMLU | 75.0 | 88.7 | 88.3 |

| HumanEval | 71.0 | 90.2 | 92.0 |

| MATH Lvl 5 | 44.0 | 76.6 | 71.1 |

| GSM8K | 66.9 | 95.8 | 96.4 |

벤치마크 수치만 보면 경쟁력이 낮아 보이지만, RAG와 도구 사용이라는 특정 영역에서는 사정이 다르다. 인용 정확도와 멀티홉 QA에서 GPT-4 Turbo를 넘긴 것이 Cohere의 공식 주장이다. 다만 GPQA, MMLU-Pro, IFEval 등 최신 벤치마크 점수는 공개되어 있지 않아 정확한 비교가 어렵다.

실제 사용 체감에서도 "RAG에 넣으면 괜찮은데, 범용 대화에서는 GPT-4o가 훨씬 낫다"는 평가가 일반적이다. 처리량 50% 향상과 지연시간 25% 단축이라는 08-2024 업데이트의 효과는 API 응답 속도 면에서 긍정적이지만, 모델의 근본적인 지능 수준 자체가 올라간 것은 아니다.

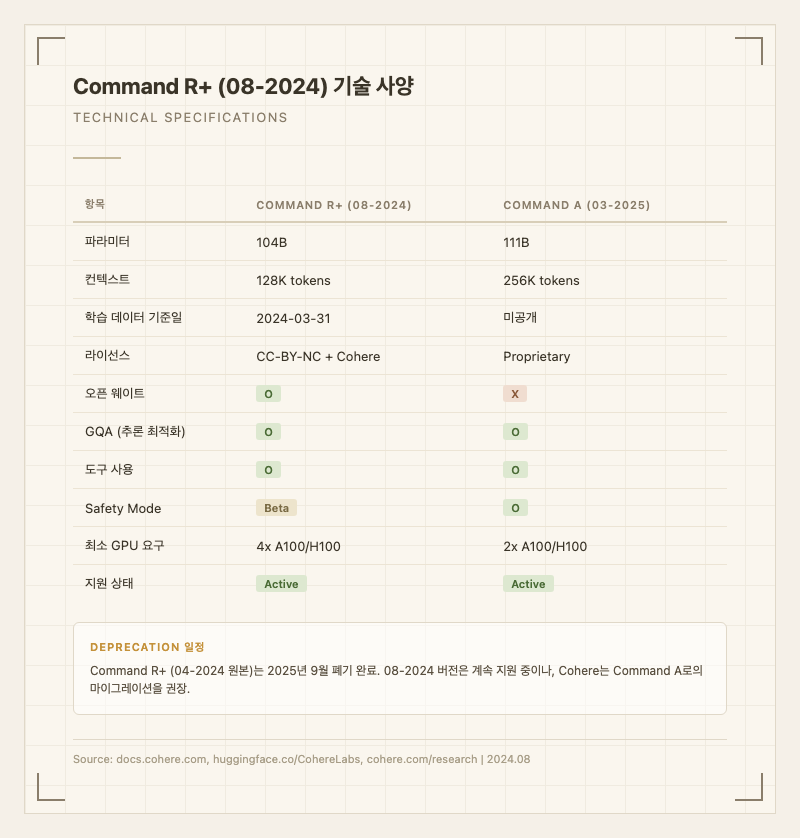

한 가지 주의할 점은, Cohere의 후속 모델인 Command A(2025년 3월)가 111B 파라미터에 256K 컨텍스트, 150% 높은 처리량으로 나왔기 때문에 순수 성능 기준으로는 Command R+를 선택할 이유가 줄어들고 있다.

사용 방법

Command R+ (08-2024)는 여러 경로로 접근할 수 있다.

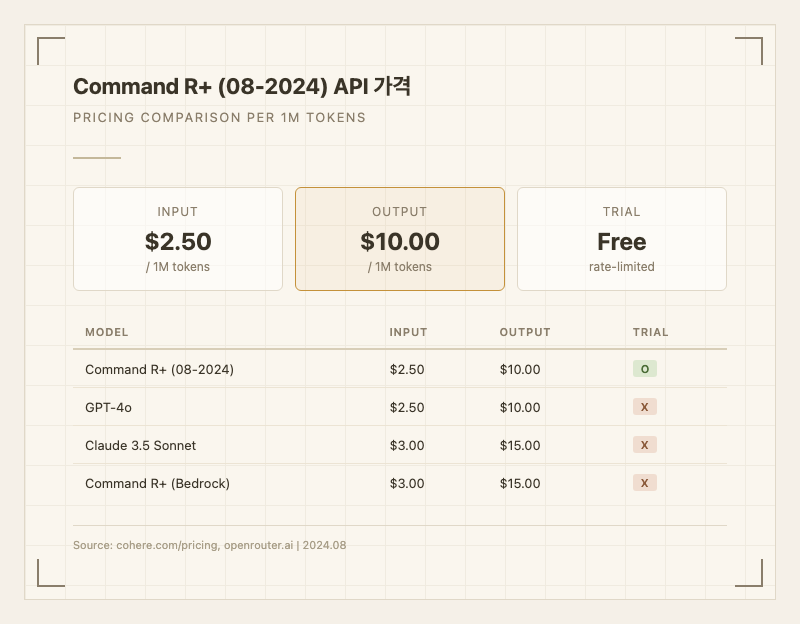

Cohere API (직접 호출): Cohere 계정을 만들면 Trial API 키가 무료로 발급된다. Rate limit이 있지만 테스트 용도로 충분하다. Production 키로 전환하면 종량제(pay-as-you-go)로 과금된다. API 엔드포인트에서 모델명으로 command-r-plus-08-2024를 지정하면 된다.

클라우드 제공자: AWS Bedrock, Azure AI Studio, Oracle OCI Generative AI에서 관리형 서비스로 사용 가능하다. AWS Bedrock에서는 cohere.command-r-plus-08-2024-v1:0으로 호출한다. 단, 클라우드 제공자를 통할 경우 가격이 직접 호출보다 높다(Bedrock: 입력 15.00).

자체 호스팅: HuggingFace에 오픈 웨이트로 공개되어 있어(CohereLabs/c4ai-command-r-plus-08-2024) 자체 인프라에 배포할 수 있다. 다만 104B 파라미터 모델이므로 최소 A100/H100 GPU 4장이 필요하다.

공식 문서: https://docs.cohere.com/docs/command-r-plus

가격

API 가격은 입력 10.00/1M 토큰이다 (출처: cohere.com/pricing). GPT-4o와 거의 동일한 가격대다. Claude 3.5 Sonnet(입력 15.00)보다는 저렴하다.

AWS Bedrock을 통해 사용할 경우 입력 15.00으로 직접 호출 대비 20-50% 비싸다. Trial 키는 무료지만 rate limit이 적용된다.

가성비 측면에서 보면, RAG 특화 용도로 쓸 경우 동일 가격대의 GPT-4o 대비 인용 정확도에서 우위가 있으므로 가성비가 좋다고 할 수 있다. 하지만 범용으로 쓸 경우 벤치마크 성능이 낮아 가격 대비 성능이 떨어진다.

한국어 토큰 효율에 대한 구체적 데이터는 미공개 상태다. Cohere는 한국어를 최적화 대상 10개 언어에 포함시켰으나, 실제 토크나이저의 한국어 토큰 효율(영어 대비 몇 배의 토큰을 소모하는지)에 대한 공식 수치는 발표하지 않았다.

기술 사양

| 항목 | 사양 |

|---|---|

| 파라미터 수 | 104B (1,040억) |

| 컨텍스트 윈도우 | 128,000 토큰 |

| 아키텍처 | Transformer + Grouped Query Attention (GQA) |

| 학습 데이터 기준일 | 2024-03-31 |

| 라이선스 | CC-BY-NC + Cohere 이용약관 (상업적 사용 시 Cohere SaaS 계약 필요) |

| 오픈 웨이트 | HuggingFace에서 다운로드 가능 |

| 출시일 | 2024-08-30 |

| 최적화 언어 | 영어, 프랑스어, 스페인어, 이탈리아어, 독일어, 포르투갈어(브라질), 일본어, 한국어, 아랍어, 중국어(간체) |

| 추가 학습 언어 | 러시아어, 폴란드어, 터키어, 베트남어, 네덜란드어, 체코어, 인도네시아어, 우크라이나어, 루마니아어, 그리스어, 힌디어, 히브리어, 페르시아어 |

| 지원 상태 | 유지 중 (후속 모델 Command A 출시, Cohere는 마이그레이션 권장) |

Command R+ (04-2024) 원본은 2025년 9월 15일부로 폐기되었다. 08-2024 버전은 계속 유지되고 있지만, Cohere는 Command A (03-2025)로의 마이그레이션을 권장하고 있다. Command A는 111B 파라미터에 256K 컨텍스트, 150% 높은 처리량을 제공하며 GPU 2장으로 운용이 가능하다.

참고 자료

스펙

컨텍스트 윈도우

128K 토큰

라이선스

CC-BY-NC + Cohere SaaS Agreement

출시일

2024년 8월 30일

학습 마감일

2024년 3월 31일

가성비 지수

0.6

API 가격 (혼합)

입력 $2.50/1M

조회수

0

API 가격 (USD 기준)

입력 (Prompt)

$2.50 / 1M 토큰

출력 (Completion)

$10.00 / 1M 토큰

용도별 성능

태스크 관련 벤치마크 평균 점수

코딩최강

71.0

코드 생성, 버그 수정, 소프트웨어 엔지니어링

수학/추론

44.0

수학, 과학, 논리적 추론

Provider

Cohere

https://cohere.comCohere의 다른 모델

분류

자연어 처리컴퓨터 비전오디오 처리TransformerLLM

성능 평가

꼭지점 클릭 → 벤치마크 행 이동

| 벤치마크 | 이 모델 | 단위 |

|---|---|---|

| GSM8K | 66.9 | % |

| HumanEval | 71.0 | % |

| MATH Lvl 5 | 44.0 | % |

유사 모델 비교

| 모델 | LLM 점수GPQA·MMLU·MATH·IFEval·HumanEval |

|---|---|

| Command R+ (08-2024) | 51.7 |

| o1-pro | 86.4 |

| o3 | 88.8 |

| Grok 4.1 Fast | 74.4 |

| Command A | 69.1 |