ElevenLabs

Enterprise미디어/크리에이티브미디어/엔터테인먼트고객지원교육

종합 평점

4.2/ 5.0

리뷰

2개

가격 플랜

7개 플랜

사용 모델

—

플랫폼별 평점

4.2

종합 평점

5

2

4

요약: ElevenLabs은(는) AI 서비스. 주요 Task: Text-to-Speech (음성 합성), Automatic Speech Recognition (자동 음성 인식), Music Generation (음악 생성). 종합 평점: 4.2/5.0.

ElevenLabs는 Mati Staniszewski와 Piotr Dabkowski가 2022년에 설립한 AI 음성 플랫폼이다. 텍스트를 사람과 구분하기 어려울 정도로 자연스러운 음성으로 변환하는 TTS 기술을 핵심으로, 음성 복제, 음성 에이전트, 음악 생성, 음성 인식(STT)까지 아우르는 올인원 오디오 AI 플랫폼으로 확장했다.

경쟁 비교

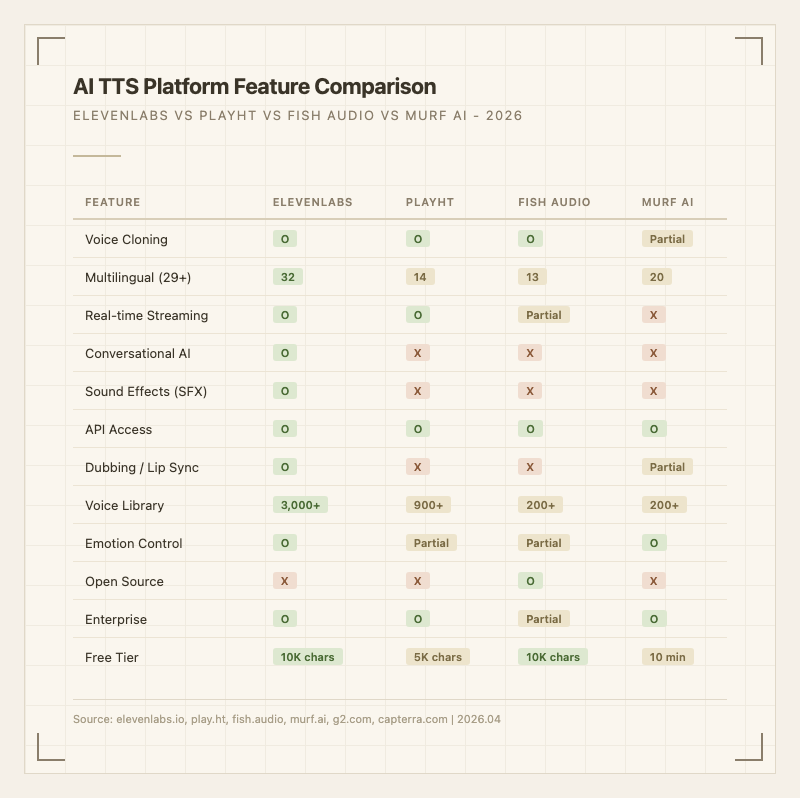

vs PlayHT

PlayHT는 600개 이상의 음성과 140개 이상의 언어를 지원해서 다국어 커버리지 측면에서는 ElevenLabs보다 넓다. 그러나 ElevenLabs의 Eleven v3 모델은 Audio Tags(예: [whispers], [shouts])로 감정 연출을 세밀하게 제어할 수 있는 반면, PlayHT에는 이에 해당하는 기능이 없다. 실시간 지연시간도 ElevenLabs Flash v2.5가 75ms인데 비해 PlayHT는 200ms 수준이어서 실시간 대화형 에이전트에서는 차이가 난다. PlayHT는 Twilio 통합으로 전화 시스템 연동이 편리하고, 무제한 생성을 제공하는 플랜($31/월)이 있어서 대량 생산에는 가격 효율이 좋다 (play.ht).

vs Fish

Audio

Fish Audio는 TTS-Arena 블라인드 테스트에서 1위를 차지하며 음성 품질 면에서 ElevenLabs와 대등하거나 더 높은 평가를 받았다 (ringly.io). 가격은 ElevenLabs 대비 약 80% 저렴해서($10/월 200분) 비용 대비 효율이 압도적이다. 오픈소스 모델(Fish Speech 1.6)도 제공해서 셀프호스팅이 가능하다. 반면 지원 언어가 13개 정도로 ElevenLabs(70개 이상)에 비해 제한적이고, 음성 에이전트나 더빙 같은 확장 기능은 없다.

vs Murf AI

Murf AI는 120개 이상의 음성을 제공하며 직관적인 인터페이스로 비전문가도 쉽게 사용할 수 있다. 마케팅 영상, 사내 프레젠테이션, 고객 서비스 오디오 같은 단발성 콘텐츠 제작에 적합하다 (murf.ai). 그러나 음성 복제는 Pro 플랜 이상에서만 가능하고, 감정 제어는 제한적이며, 음악 생성이나 음성 에이전트 기능은 없다. ElevenLabs가 기능 범위 면에서 훨씬 넓다.

ElevenLabs만의 차별점은 TTS, 음성 복제, 에이전트, 음악, STT를 하나의 플랫폼에서 제공하는 유일한 서비스라는 점이다. 개별 기능에서는 더 싸거나(Fish Audio) 더 넓은 음성 선택지(PlayHT)를 제공하는 경쟁사가 있지만, 이 모든 것을 통합한 플랫폼은 현재 ElevenLabs뿐이다.

장단점

장점

- 업계 최고 수준의 음성 자연스러움. "로봇 같지 않고 진짜 사람이 말하는 것 같다"는 평가가 반복적으로 등장한다 (Capterra 리뷰). Eleven v3 모델은 화학식이나 전화번호 같은 복잡한 텍스트에서 오류를 68% 줄였다 (공식 문서).

- Audio Tags로 감정 연출을 세밀하게 제어할 수 있다. [whispers], [sighs], [shouts] 같은 태그를 텍스트에 삽입하면 AI가 해당 감정으로 읽는다 (공식 문서).

- Flash v2.5 모델의 75ms 지연시간은 실시간 대화형 에이전트 구축에 적합하다. Klarna, Deutsche Telekom 같은 대형 기업이 고객 상담에 실전 배치했다 (공식 블로그).

- 70개 이상 언어를 지원하며, 한국어 품질도 양호하다. Multilingual v2 모델이 특히 다국어 콘텐츠 제작에 강하다 (공식 문서).

- Scribe v2로 음성 인식(STT)까지 지원해서 녹취록 + TTS 워크플로우를 한 플랫폼에서 처리할 수 있다 (공식 문서).

단점

- 크레딧 소모 속도가 빠르다. 실패한 생성에도 크레딧이 차감되어 실제 사용 비용이 광고 단가의 2.2~2.8배에 달한다는 리포트가 있다 (qcall.ai 리뷰). -> 200단어 이하 청크로 나눠서 생성하면 실패율을 78% 줄일 수 있다.

- 긴 텍스트에서 AI가 중간에 억양이나 언어를 바꾸는 현상이 발생한다. 10분짜리 오디오가 미국 영어로 시작해서 영국 영어로 끝나는 사례가 보고된다 (Reddit r/elevenlabs). -> 텍스트를 짧은 단위로 분할해서 생성하면 완화된다.

- 음성 복제 품질이 입력 오디오 품질에 크게 의존한다. 전문 녹음 환경 없이 클론하면 "끔찍하게 가짜 같다"는 평가가 많다 (Trustpilot 리뷰). -> Professional Voice Clone(PVC)을 사용하려면 30분 이상의 스튜디오급 오디오가 필요하다.

- 고객 지원 응답이 느리다. 무료 플랜 7-14일, 유료 플랜 3-7일 소요되며 이메일 전용이다 (Trustpilot 리뷰). -> Enterprise 플랜은 전담 지원을 포함한다.

- 미사용 크레딧의 이월이 플랜에 따라 제한적이다. 한 달 사용량이 적으면 그만큼 비용을 낭비하게 된다 (G2 리뷰). -> 연간 결제 시 약 17% 할인이 적용되므로 사용 패턴이 일정하면 연간 플랜이 유리하다.

타겟 사용자

| 타겟 | 시나리오 | 적합도 |

|---|---|---|

| 유튜버/팟캐스터 | 나레이션, 오디오북 자동 생성 | 최적 - 음성 품질이 업계 최고 수준이고 Projects 기능으로 장편 콘텐츠 관리 가능 |

| 기업 고객센터 | 24/7 음성 AI 에이전트 배치 | 최적 - Klarna, Deutsche Telekom 등 실전 검증 완료. HIPAA, SOC 2 컴플라이언스 지원 |

| 게임 개발사 | NPC 대사 대량 생성 | 좋음 - Audio Tags로 캐릭터별 감정 연출 가능. 단, 대량 생성 시 크레딧 비용 관리 필요 |

| 교육 콘텐츠 제작자 | e-러닝 다국어 강의 음성 | 좋음 - 70개 이상 언어 지원. StudyLab AI, MasterClass 등 교육 분야 사용 사례 존재 |

| 영상 제작 스튜디오 | 다국어 더빙 + 립싱크 | 좋음 - Dubbing Studio로 자동 더빙 가능. 단, 더빙 시 크레딧 소모가 빠르므로 Scale 이상 플랜 권장 |

| 소규모 블로거/SNS 크리에이터 | 짧은 TTS 클립 생성 | 주의 - 무료 플랜 10K 크레딧(약 10분)은 금방 소진됨. Starter($5) 이상 필요 |

| 예산 민감한 대량 TTS 사용자 | 비용 효율 최우선 | 부적합 - Fish Audio($10/월 200분)가 80% 저렴하면서 품질도 대등 |

가격

ElevenLabs는 크레딧 기반 과금 체계를 사용한다. Multilingual v2 모델 기준 1크레딧 = 1글자이고, Flash/Turbo 모델은 0.5크레딧/글자여서 같은 크레딧으로 2배 분량을 생성할 수 있다.

Free 플랜은 월 10,000 크레딧(약 10분 분량)을 제공하지만 상업적 이용이 불가하고 ElevenLabs 출처 표기가 필수다. 음성 복제도 사용할 수 없다.

Starter($5/월)부터 상업적 이용권과 즉석 음성 복제가 열린다. 30,000 크레딧(약 30분)을 제공하며, 짧은 콘텐츠를 가끔 만드는 개인 크리에이터에게 적합하다.

Creator($22/월)는 100,000 크레딧과 Professional Voice Clone 1개를 포함한다. 192kbps 고음질 출력이 가능하고, 주기적으로 콘텐츠를 제작하는 크리에이터의 주력 플랜이다.

Pro(330/월)은 2,000,000 크레딧을 제공한다. Business($1,320/월)는 11,000,000 크레딧에 SLA와 15석 이상의 팀 좌석을 포함한다.

초과 사용 시 티어별로 차등 과금된다: Creator 0.24, Scale 0.12. 연간 결제 시 약 17%(2개월분) 할인이 적용된다.

경쟁사 대비 가격 포지셔닝은 "프리미엄"이다. 같은 $20-30 구간에서 Fish Audio는 200분을 제공하는 반면 ElevenLabs Creator는 약 100분(Flash 기준)이다. 단, ElevenLabs는 에이전트, 더빙, 음악 생성 등 부가 기능이 포함되어 있어서 단순 TTS 단가만으로 비교하기 어렵다.

결과물 품질 비교 + 후처리 워크플로우

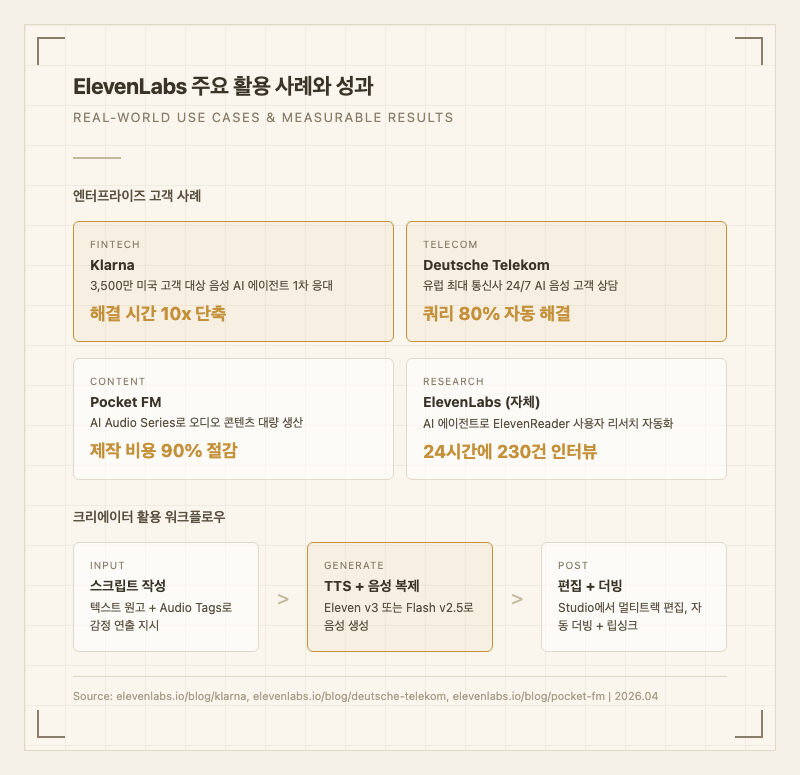

엔터프라이즈 사례

Klarna - 핀테크 기업 Klarna는 ElevenAgents를 활용해 3,500만 미국 고객 대상 음성 AI 에이전트를 1차 응대 창구로 배치했다. 고객의 전화 문의를 AI 에이전트가 먼저 받아서 정보 요청 처리, 맥락 수집, 필요 시 상담원 전달까지 자동으로 수행한다. 그 결과 에이전트가 처리하는 문의의 해결 시간이 기존 대비 10배 단축되었다 (elevenlabs.io/blog/klarna).

Deutsche Telekom - 유럽 최대 통신사 Deutsche Telekom은 ElevenLabs 음성 에이전트를 고객 서비스에 도입해서 24시간 대기시간 없는 상담을 제공한다. 내부 데이터 기준으로 사용자 쿼리의 약 80%를 AI 에이전트가 자동 해결하며, 특히 문서 관련 질문에서 높은 정확도를 보인다 (elevenlabs.io/blog/deutsche-telekom).

Pocket FM - 오디오 시리즈 플랫폼 Pocket FM은 ElevenLabs와 협력해 AI Audio Series를 출시했다. Voice AI 기술로 오디오 콘텐츠를 대량 생산하면서 제작 비용을 최대 90%까지 절감했다 (elevenlabs.io/blog/pocket-fm).

크리에이터 워크플로우

ElevenLabs의 콘텐츠 제작 워크플로우는 크게 3단계로 구성된다. 먼저 텍스트 원고에 Audio Tags를 삽입해서 감정 연출을 지시한다. 다음으로 Eleven v3(고품질) 또는 Flash v2.5(저지연)를 선택해서 음성을 생성한다. 마지막으로 Studio에서 멀티트랙 편집, 더빙, 립싱크를 적용해서 최종 콘텐츠를 완성한다.

50,000 단어 오디오북을 제작한 한 리뷰어의 테스트에 따르면, 347회의 재생성이 필요했고 실제 크레딧 사용량은 광고 단가의 2.4배였으며, 총 67시간의 작업 시간이 소요되었다 (qcall.ai). 이는 전문 성우 녹음 대비 비용은 크게 절감되지만, "원클릭으로 끝나는" 작업은 아님을 보여준다. 200단어 이하 청크로 나누고, 생성 실패 시 프롬프트를 조정하는 반복 작업이 필요하다.

음악 생성

2026년 4월 출시된 ElevenMusic iOS 앱에서 자연어 프롬프트로 하루 최대 7곡을 무료 생성할 수 있다. 특정 구간(코러스, 가사 등)만 선택해서 재생성하는 인페인팅 기능을 지원하며, 유료 Stem Separation 기능으로 보컬/드럼/베이스 등 개별 트랙 분리가 가능하다 (TechCrunch).

참고 자료

기술 스택

ElevenLabs

Task

Text-to-Speech (음성 합성)

Automatic Speech Recognition (자동 음성 인식)

Music Generation (음악 생성)

Audio-to-Text Generation (오디오-텍스트 변환)

서비스 정보

웹사이트

바로가기Task

Text-to-Speech (음성 합성)Automatic Speech Recognition (자동 음성 인식)Music Generation (음악 생성)Audio-to-Text Generation (오디오-텍스트 변환)

가격 플랜

Business

$1,320/월

monthly

초과 사용 $0.12/1K글자

- 11,000,000 크레딧/월

- Flash 모델 22,000,000 크레딧

- Professional Voice Clone 3개

- 192kbps + SLA

- 15+석

- 동시 15개 생성

Creator

$22/월

monthly

초과 사용 $0.30/1K글자

- 100,000 크레딧/월

- Flash 모델 200,000 크레딧

- Professional Voice Clone 1개

- 192kbps 고음질

- 동시 5개 생성

Enterprise

별도문의

custom

- 커스텀 크레딧 협상

- 커스텀 SLA

- SSO, HIPAA/BAA 컴플라이언스

- 전담 지원

- 볼륨 할인

Free

무료

monthly

상업적 이용 불가, ElevenLabs 출처 표기 필수, 음성 복제 불가

- 10,000 크레딧/월 (Multilingual v2 기준 약 10분)

- Flash 모델 20,000 크레딧

- 128kbps 음질

- 동시 2개 생성

- 3개 프로젝트

- 3개 커스텀 음성

Pro

$99/월

monthly

초과 사용 $0.24/1K글자

- 500,000 크레딧/월

- Flash 모델 1,000,000 크레딧

- Professional Voice Clone 1개

- 192kbps 고음질

- 동시 10개 생성

Scale

리뷰 (2)

G2ki****

다국어 지원이 강점

70개 이상 언어 지원으로 로컬라이제이션 프로젝트에 탁월. 한국어 음성도 자연스러움.

%20(2).webp)

![Elevenlabs vs Wellsaid Labs: Tried Both & Here's the Winner [2025]](https://cdn.prod.website-files.com/66bbe17b9639de563ee20c7a/676e729abece367f79df19aa_Group%201171283829.png)