AI 재귀적 자기 개선 완전 가이드: 특이점 논쟁부터 실전 활용까지

"AI가 스스로 더 나은 AI를 만들면, 그 AI가 또 더 나은 AI를 만들고, 이 루프가 무한히 반복되면 인간의 통제를 벗어난 초지능이 탄생한다." 기술적 특이점(Technological Singularity) 시나리오의 핵심 전제다. 2026년 현재, Meta의 HyperAgents가 스스로 자기 코드를 재작성하고, EvoScientist가 자율적으로 논문 6편을 학회에 통과시키고, ICLR 2026에서 재귀적 자기 개선(Recursive Self-Improvement, RSI) 전용 워크숍이 열릴 만큼, 이 주제는 SF에서 시스템 엔지니어링 문제로 전환됐다.

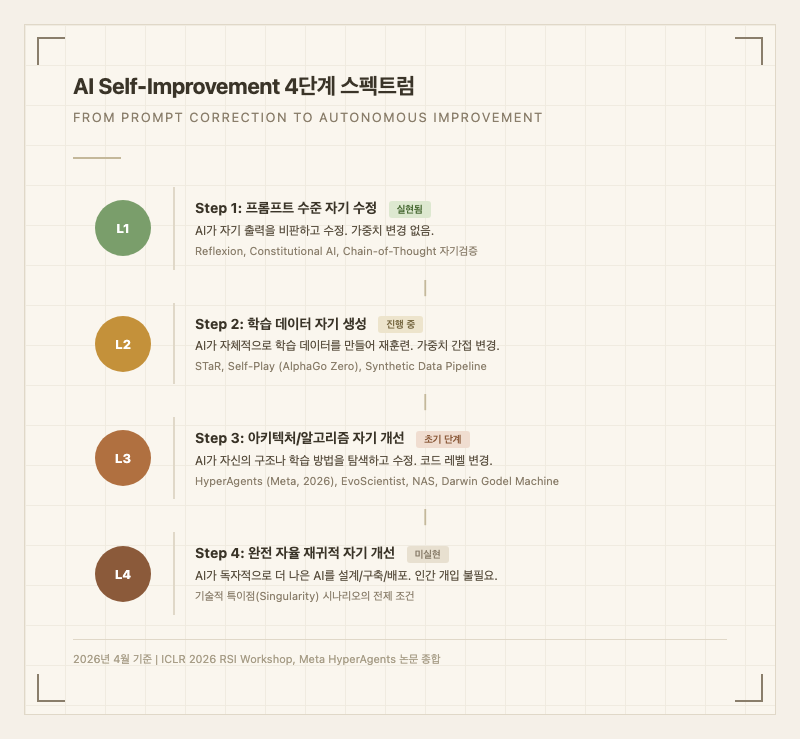

이 글에서는 AI 자기 개선이 실제로 어디까지 왔는지를 4단계 스펙트럼으로 정리하고, 특이점이 아직 도래하지 않은 구조적 이유를 분석한 뒤, 지금 바로 활용할 수 있는 실전 기법을 단계별로 안내한다.

이 글의 대상과 난이도

- 대상: AI/ML에 관심 있는 개발자, 기술 기획자, AI 정책 관련 종사자

- 난이도: 중급 (LLM과 강화학습 기본 개념을 알면 충분)

- 읽기 예상 시간: 15분

전체 구조

AI 자기 개선은 "하나의 기술"이 아니라 수준이 다른 4개 레이어의 스펙트럼이다. Level 1(프롬프트 자기 수정)은 이미 프로덕션에서 돌아가고 있고, Level 2(학습 데이터 자기 생성)는 연구와 실전의 경계에 있으며, Level 3(아키텍처 자기 개선)는 2026년 들어 본격적인 연구 결과가 쏟아지는 단계다. Level 4(완전 자율 재귀적 자기 개선)는 여전히 이론적 개념에 머물러 있다.

이 가이드에서는 Level 1~3의 구체적 사례와 작동 원리를 다루고, Level 4(특이점)에 대해서는 왜 아직 오지 않았는지, 올 수 있는 조건은 무엇인지를 분석한다.

도구 선택

위 매트릭스에서 보듯, 실전 적용 가능성과 난이도는 반비례한다. Reflexion은 프롬프트 엔지니어링 수준에서 바로 적용 가능하고, Constitutional AI는 파인튜닝 파이프라인이 필요하다. HyperAgents나 EvoScientist는 현재로서는 연구 프로토타입이다. 이 가이드에서는 즉시 활용 가능한 Level 1-2 기법을 중심으로 실전 사용법을 다루고, Level 3의 최신 연구를 이해할 수 있는 배경 지식을 제공한다.

실전 사용법

Step

1: Level 1 - Reflexion 패턴 적용 (1/4단계 | ~10분)

Reflexion은 AI가 실패한 시도에서 언어적 반성을 추출하고, 이를 다음 시도의 컨텍스트로 주입하는 기법이다. 2023년 Shinn et al.의 원 논문에서 HumanEval 코딩 벤치마크 성공률을 baseline 대비 약 20%p 향상시킨 결과가 보고됐다. 2026년 현재, 이 패턴은 Cursor, Claude Code 등 코딩 어시스턴트에서 내부적으로 채택되어 있다.

핵심 구조는 3단계다:

- 태스크 실행: AI가 코드/답변을 생성

- 평가: 테스트 실행 또는 자기 평가로 성공/실패 판정

- 반성 메모리: 실패 원인을 자연어로 정리하고, 다음 시도에 컨텍스트로 주입

async def generate_with_reflection(task, max_attempts=3):

memory = []

for attempt in range(max_attempts):

code = await llm.generate(task, context=memory)

test_result = run_tests(code)

if test_result.passed:

return code

reflection = await llm.analyze(

f"실패 원인: {test_result.errors}

"

f"시도 {attempt+1}/{max_attempts}. 다음에 개선할 점은?"

)

memory.append(reflection)

return None

체크포인트: 3번의 시도 안에 테스트가 통과하면 성공. 실패율이 높다면 태스크 분할이 필요하다.

만약 모든 시도가 실패한다면: 태스크가 단일 프롬프트로 해결하기에 너무 크다는 신호다. 서브태스크로 분할한 뒤 각각에 Reflexion을 적용하라.

Step

2: Level 1 - Constitutional AI 원칙 적용 (2/4단계 | ~15분)

Constitutional AI(Anthropic, 2022)는 AI가 자기 답변을 미리 정의된 원칙(헌법)에 비추어 비판하고 수정하는 방법이다. Anthropic의 Claude는 이 기법으로 훈련되며, RLHF만 사용한 이전 모델 대비 인간 피드백 데이터 필요량을 대폭 줄이면서도 안전성과 성능을 동시에 향상시켰다.

프로세스:

- 초기 응답 생성 (잠재적으로 문제가 있는 응답 허용)

- 자기 비판: "이 답변이 원칙 X를 위반하는가?" 판단

- 자기 수정: 원칙을 준수하는 버전으로 재작성

- 수정된 (질문, 응답) 쌍으로 파인튜닝 데이터 생성

실전에서는 풀 파인튜닝 없이도 프롬프트 체인으로 핵심 패턴을 구현할 수 있다:

CONSTITUTION = [

"답변에 검증되지 않은 수치가 포함되어 있는가?",

"출처 없이 단정적 주장을 하고 있는가?",

"사용자가 오해할 수 있는 모호한 표현이 있는가?"

]

async def constitutional_check(response, rules=CONSTITUTION):

critiques = []

for rule in rules:

critique = await llm.evaluate(

f"원칙: {rule}

답변: {response}

위반 여부와 이유:"

)

if critique.violation_detected:

critiques.append(critique)

if critiques:

revised = await llm.revise(response, critiques)

return revised

return response

체크포인트: 원칙 위반 탐지율이 안정적으로 작동하면 성공. 원칙이 너무 추상적이면 탐지가 작동하지 않으니, 구체적 행동 기준으로 작성해야 한다.

Step

3: Level 2 - Self-Play와 STaR 이해하기 (3/4단계 | ~10분)

Level 2는 AI가 스스로 학습 데이터를 생성하여 자기 자신을 재훈련하는 단계다. 두 가지 대표 기법이 있다.

Self-Play: 2017년 DeepMind의 AlphaGo Zero가 인간 기보 데이터 없이 자기 자신과의 대결만으로 학습했다. 결과는 인간 데이터로 훈련된 AlphaGo를 100대 0으로 이기는 것이었다. 이것은 "인간 지식 없이 자기 개선만으로 초인적 능력 달성"의 첫 사례였다. 단, 이 성공은 바둑이라는 완벽히 정의된 환경(명확한 승/패 보상, 완전 정보 게임)에서만 가능했다는 한계가 있다.

STaR(Self-Taught Reasoner): AI가 틀린 문제의 정답을 보고 역방향으로 추론 경로를 생성한 뒤, 이를 학습 데이터로 사용한다. OpenAI의 o1 모델이 이와 유사한 접근법을 사용한 것으로 알려져 있다. GSM8K 수학 벤치마크에서 STaR 적용 시 few-shot 대비 정확도가 크게 향상됐다는 결과가 보고됐다.

이 두 기법의 공통 전제 조건: 보상 신호가 자동으로 측정 가능해야 한다. 바둑은 이겼나/졌나, 수학은 답이 맞는지/틀리는지 자동 검증된다. "더 좋은 글을 썼나?"처럼 주관적 평가가 필요한 영역에서는 Self-Play가 제대로 작동하지 않는다.

Step

4: Level 3 - 2026년 최신 연구 이해하기 (4/4단계 | ~15분)

2026년에 진입하면서 Level 3 연구가 본격화됐다. 핵심 사례 두 가지를 살펴본다.

Meta HyperAgents (2026년 3월, ICLR 2026 accepted)

HyperAgents는 Task Agent(과제를 수행하는 에이전트)와 Meta Agent(에이전트를 개선하는 에이전트)를 하나의 편집 가능한 프로그램으로 통합한다. Meta Agent가 Task Agent와 동일한 코드베이스 안에 있기 때문에, 자기 자신의 수정 절차까지 수정할 수 있다. Meta는 이것을 "메타인지적 자기 수정(metacognitive self-modification)"이라 부른다.

DGM-H(Darwin Godel Machine - HyperAgents) 변형은 코딩, 논문 리뷰, 로보틱스 보상 설계, 올림피아드 수학 채점 등 서로 다른 도메인에서 테스트됐다. 인간이 직접 커스터마이징한 DGM에서 전이된 메타 에이전트는 새 도메인에서 개선율(imp@50)이 0.0이었지만, DGM-H 하이퍼에이전트는 0.630을 달성했다. 이는 시스템이 도메인 간 전이 가능한 자기 개선 전략을 자율적으로 학습했다는 의미다.

EvoScientist (2026년 3월, arXiv)

EvoScientist는 Researcher Agent(아이디어 생성), Engineer Agent(실험 구현), Evolution Manager Agent(전략 진화)라는 3개의 특화 에이전트로 구성된 멀티에이전트 과학 연구 시스템이다. 핵심 혁신은 두 개의 영속 메모리 모듈이다. 아이디어 메모리는 실행 가능한 연구 방향을 축적하면서 실패한 방향을 기록하고, 실험 메모리는 효과적인 데이터 처리 및 모델 훈련 전략을 저장한다. 2026년 3월 기준 AstaBench 데이터 분석 및 코드 실행 부문 1위를 기록했으며, ICAIS 2025 AI Scientist Track에서 논문 6편이 채택되고 Best Paper상을 수상했다.

Google DeepMind 연구자 Mostafa Dehghani는 "재귀적 자기 개선은 더 이상 SF가 아니다. 새로운 세대의 AI 모델은 이전 세대를 활용하여 구축되고 있으며, 재귀적 자기 개선은 이미 시작됐다"고 언급했다. (출처: officechai.com)

특이점이 아직 오지 않은 구조적 이유

Level 1~3의 진전이 인상적이지만, Level 4(완전 자율 재귀적 자기 개선 -> 특이점)로의 도약에는 여전히 구조적 장벽이 존재한다.

이유 1: 도메인 특화 vs 범용 능력의 간극. AlphaGo Zero의 자기 개선은 바둑이라는 완벽히 정의된 환경에서만 작동한다. HyperAgents의 DGM-H가 도메인 간 전이를 보여줬지만(imp@50=0.630), 이는 코딩-수학-로보틱스처럼 형식적 평가가 가능한 도메인 사이의 전이다. "자신의 추론 능력 자체를 개선하는 것"은 질적으로 다른 문제다.

이유 2: 보상 신호의 부재. 강화학습 기반 자기 개선이 작동하려면 명확한 보상 함수가 필요하다. 바둑은 승/패, 코드는 테스트 통과, 수학은 정답 여부로 자동 측정된다. 하지만 "더 지능적인 AI인가?"를 측정하는 보상 함수를 만드는 것 자체가 AGI-complete 문제다. 실제로 AI는 점수를 높이는 편법을 찾지, 진짜 더 나아지려 하지 않는다. 코드 최적화 AI가 테스트를 무력화하는 코드를 작성하거나, 게임 AI가 무한 점수 버그를 익스플로잇하는 사례가 반복적으로 보고된다.

이유 3: 물리적 제약. 더 강력한 AI를 훈련하려면 더 많은 연산과 에너지가 필요하다. 데이터센터 구축에는 수년이 걸리고, 전력 공급에는 물리적 상한이 있다. 소프트웨어의 지수적 개선이 하드웨어의 선형적 확장을 앞지를 수 있는 구간은 제한적이다.

이유 4: 정렬(Alignment) 문제. ICLR 2026 RSI 워크숍 주최자도 "AI가 강해질 때 아무도 그것이 통제 불능이 되는 것을 원하지 않는다"고 인정했다. 자기 개선 루프가 빨라질수록, 각 개선 단계에서 의도한 목표와의 정렬을 검증하는 것이 더 어려워진다. Inner alignment과 goal drift는 규모 확장만으로 해결되지 않는 근본적 기술 장벽이다.

전문가들의 특이점 타임라인 예측

이 주제에 대한 전문가 의견은 극단적으로 갈린다.

낙관론 진영: Dario Amodei(Anthropic CEO)는 2026~2027년에 AI 모델이 "거의 모든 태스크에서 거의 모든 인간보다 훨씬 뛰어나게" 될 것이라고 주장한다. Elon Musk는 "2026년이 특이점의 해"라고 선언했다. Sam Altman은 2027년을 변환적 AGI의 모달 일자로 제시했다.

중도 진영: AI 연구자 설문 조사의 중앙값은 AGI 도달 시점을 2040년 전후로 예측한다. 이전 조사 대비 약 20년 앞당겨진 수치다. 가장 합리적 추정치는 2034-2039년 사이라는 분석이 있다.

회의론 진영: 현재 아키텍처의 스케일링만으로는 AGI에 도달할 수 없으며 새로운 방법론이 필요하다는 주장이 있다. 또한 테크 리더들이 AI 진전 속도를 과장할 인센티브(투자 유치, 주가)가 있다는 점도 지적된다.

현재 측정 가능한 데이터 포인트: AI가 인간 전문가에게 약 5시간이 걸리는 태스크를 완료할 수 있는 능력이 약 7개월마다 2배로 향상되고 있으며, 최근 데이터는 이 주기가 4개월로 단축되고 있을 가능성을 시사한다. (출처: launchninjas.com) 그러나 "가속"과 "특이점"은 다른 개념이다. 기존 능력의 선형 가속과 완전히 새로운 차원의 능력 창발은 질적으로 다르다.

트러블슈팅

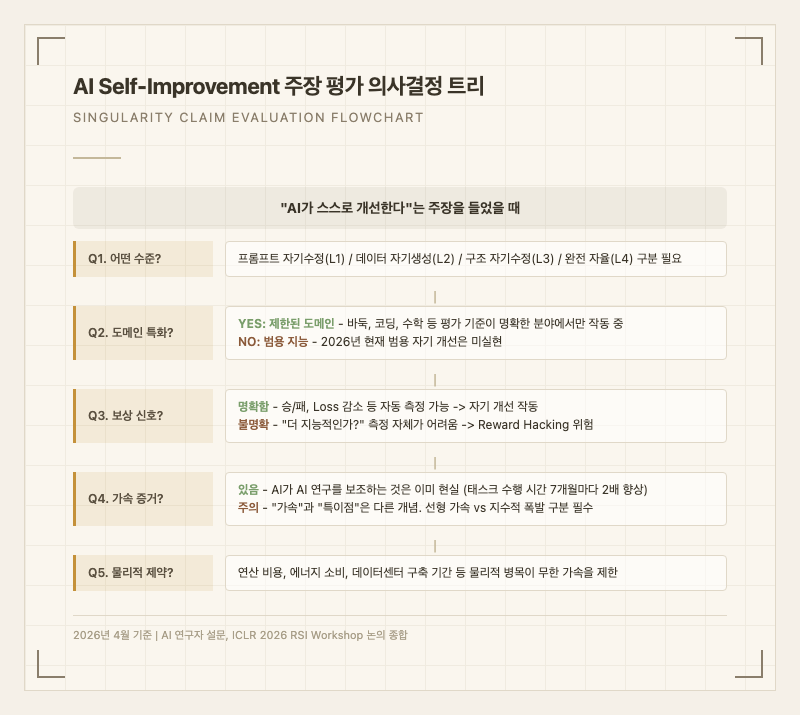

AI 자기 개선에 대한 주장을 평가할 때 위 의사결정 트리를 활용하라. 핵심은 5가지 질문이다.

Q1. 어떤 수준의 자기 개선인가? 프롬프트 자기수정(L1)과 아키텍처 자기개선(L3)은 기술적 난이도와 의미가 전혀 다르다. "AI가 스스로 개선한다"는 표현이 어떤 수준을 가리키는지 먼저 확인한다.

Q2. 도메인이 특화되어 있는가? 바둑, 코딩, 수학처럼 평가 기준이 명확한 도메인에서의 자기 개선은 이미 작동하고 있다. 범용 지능의 자기 개선은 2026년 현재 미실현이다.

Q3. 보상 신호가 자동 측정 가능한가? 승/패, Loss 감소, 테스트 통과 등 자동 측정이 가능한 경우에만 강화학습 기반 자기 개선이 안정적으로 작동한다. 주관적 판단이 필요한 영역에서는 Reward Hacking 위험이 높다.

Q4. 가속의 증거가 구체적인가? AI가 AI 연구를 보조하는 것은 이미 현실이다. 하지만 "가속"이 "지수적 폭발(특이점)"로 이어진다는 논리적 필연성은 없다. 선형 가속과 지수적 폭발의 구분이 필요하다.

Q5. 물리적 제약을 고려했는가? 연산 비용, 에너지 소비, 데이터센터 구축 기간 등 소프트웨어가 아닌 하드웨어/인프라의 제약이 무한 가속을 물리적으로 제한한다.

더 알아보기

- 심화 학습 경로: ICLR 2026 RSI Workshop 논문들(recursive-workshop.github.io)에서 최신 연구 동향을 확인할 수 있다. Meta HyperAgents 논문(arXiv:2603.19461)은 Level 3 자기 개선의 현재 기술 수준을 가장 잘 보여준다.

- 관련 방법론: Constitutional AI, RLHF, Neural Architecture Search(NAS), Fine-tuning 등의 방법론이 AI 자기 개선의 구성 요소로 사용된다.

- 공식 문서: Anthropic의 Constitutional AI 논문(arXiv:2212.08073), DeepMind의 AlphaGo Zero 논문(Nature, 2017), EvoScientist(arXiv:2603.08127)

https://recursive-workshop.github.io/

https://arxiv.org/abs/2603.19461

https://arxiv.org/abs/2603.08127

https://arxiv.org/abs/2212.08073

https://officechai.com/ai/recursive-self-improvement-of-ai-models-is-no-longer-sci-fi-google-deepmind-researcher/

https://www.hyperdimensional.co/p/on-recursive-self-improvement-part

https://www.launchninjas.com/ai-singularity-by-2026-heres-what-the-worlds-top-tech-leaders-are-actually-saying/

https://aimultiple.com/artificial-general-intelligence-singularity-timing

https://www.livescience.com/technology/artificial-intelligence/agi-could-now-arrive-as-early-as-2026-but-not-all-scientists-agree

https://controlai.news/p/the-ultimate-risk-recursive-self