R1 0528

DeepSeekLLM자연어 처리컴퓨터 비전오디오 처리128K 토큰

2025년 5월 29일MIT License

DeepSeek R1 0528이란

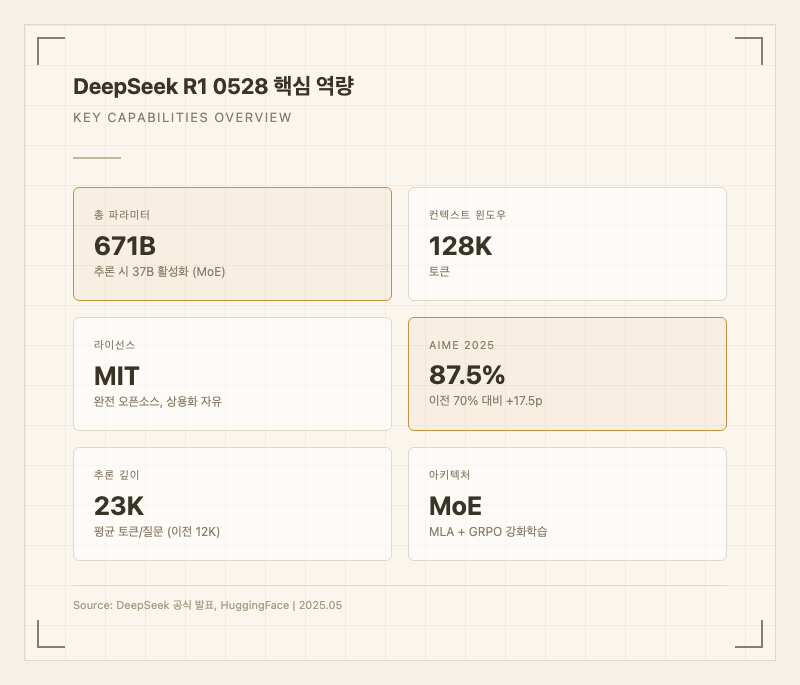

DeepSeek R1 0528은 중국 AI 스타트업 DeepSeek이 2025년 5월 28일에 출시한 추론 특화 대형 언어 모델이다. 기존 DeepSeek R1의 마이너 업데이트 버전으로, 후속 학습(post-training) 단계에서 더 많은 연산 자원과 알고리즘 최적화를 적용해 추론 깊이를 대폭 강화했다. 총 671B 파라미터에 MoE(Mixture of Experts) 아키텍처를 사용하며, 추론 시에는 37B만 활성화된다. MIT 라이선스로 전체 가중치가 HuggingFace에 공개되어 있어 상용 활용과 증류(distillation)가 자유롭다.

주요 특징

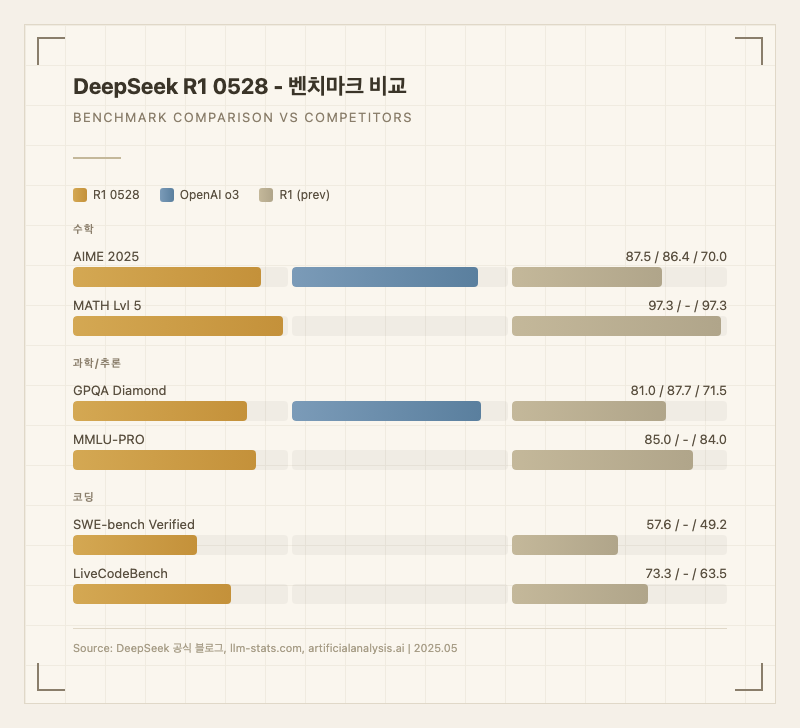

R1 0528의 가장 큰 변화는 추론 깊이의 증가다. 이전 버전이 AIME 시험에서 질문당 평균 12,000 토큰을 사용한 반면, 0528 버전은 약 23,000 토큰을 소비하며 더 깊이 생각한다 (출처: DeepSeek 공식 발표). 이 깊은 추론 덕분에 AIME 2025 정확도가 70%에서 87.5%로 올라갔다.

두 번째 특징은 코딩 능력의 대폭 강화다. LiveCodeBench가 63.5%에서 73.3%로, SWE-bench Verified가 49.2%에서 57.6%로 각각 약 10포인트, 8포인트씩 상승했다 (출처: DeepSeek 공식 블로그). 코딩 에이전트로서의 활용 가능성이 크게 넓어진 업데이트다.

세 번째는 개발자 친화적 기능 추가다. 이번 업데이트에서 JSON 구조화 출력과 function calling을 새로 지원하기 시작했다. OpenAI 호환 API 형식을 유지하고 있어 기존 파이프라인에서 즉시 교체가 가능하다.

네 번째로, MIT 라이선스 유지다. 671B 규모의 최신 추론 모델을 MIT 라이선스로 완전 공개하는 것은 여전히 이례적이다. Qwen3-8B 기반 증류 모델(DeepSeek-R1-0528-Qwen3-8B)도 함께 공개되어 개인 PC에서도 로컬 구동이 가능하다.

실사용자들의 반응을 보면, RooCode에서 여러 코딩 이슈를 한 번에 해결했다는 후기가 있고, 창작 글쓰기에서 Anthropic 최신 모델보다 낫다는 평가도 나온다. 반면 토큰 소비가 과하고, OpenRouter 기준 15-30초의 레이턴시가 문제라는 지적도 있다.

할 수 있는 것

수학과 과학 추론이 R1 0528의 가장 강한 영역이다. AIME 2024에서 91.4%, HMMT 2025에서 79.4%를 기록했으며, MATH-500에서는 97.3%로 최상위를 유지한다 (출처: DeepSeek 공식 블로그). GPQA Diamond 81%는 대학원 수준 과학 문제에서 이전 71.5% 대비 큰 폭의 향상이다.

코딩 분야에서는 실사용자들이 특히 호평한다. HumanEval 84.8%, Aider-Polyglot 71.6%를 기록하며, Aider 코딩 벤치마크에서는 Claude Sonnet 4의 61.3%를 넘어서기도 했다 (출처: llm-stats.com). Reddit과 HN에서는 "기존 코딩 챌린지를 한 번에 해결해줬다"는 후기가 다수 있다. 장기 코딩 세션에서 간혹 맥락을 놓치고 "탈선"하는 경우가 보고되기도 하지만, 단발성 코딩 작업에서는 매우 안정적이라는 평가다.

Humanity's Last Exam(HLE)에서는 17.7%를 기록해 이전 버전(8.5%) 대비 두 배 이상 올랐다 (출처: DeepSeek 공식 발표). 이는 극난이도 추론 문제에서의 실질적 개선을 보여준다.

에이전트 태스크에서는 Tau-bench Airline 53.5, Retail 63.9를 기록했다 (출처: DeepSeek HuggingFace 모델 카드). 다만 128K 컨텍스트 윈도우 제한으로 긴 에이전트 작업에서는 한계가 있다는 의견도 있다.

한국어 관련해서는, 풀사이즈 모델의 경우 한국어로 답변이 잘 나오지만 think 부분(내부 추론)은 영어로 출력되는 경향이 있다. 한국어 별도 파인튜닝 없이도 한국어 Agent 성능이 준수한 수준을 유지하며, 한국어 글쓰기에서 좋은 결과를 보인다는 실사용 후기가 있다.

성능

| 벤치마크 | R1 0528 | R1 (이전) | 비고 |

|---|---|---|---|

| AIME 2025 | 87.5% | 70.0% | +17.5p (출처: 공식 블로그) |

| AIME 2024 | 91.4% | - | (출처: 공식 블로그) |

| GPQA Diamond | 81.0% | 71.5% | +9.5p (출처: 공식 블로그) |

| MMLU-PRO | 85.0% | 84.0% | +1.0p (출처: 공식 블로그) |

| MATH Lvl 5 | 97.3% | 97.3% | 유지 (출처: 공식 블로그) |

| IFEval | 83.3% | - | (출처: 공식 블로그) |

| HumanEval | 84.8% | - | (출처: analyticsvidhya) |

| LiveCodeBench | 73.3% | 63.5% | +9.8p (출처: 공식 블로그) |

| SWE-bench Verified | 57.6% | 49.2% | +8.4p (출처: 공식 블로그) |

| HLE | 17.7% | 8.5% | x2.1 (출처: 공식 발표) |

| HMMT 2025 | 79.4% | - | (출처: 공식 블로그) |

| Tau-bench (Airline) | 53.5 | - | (출처: HuggingFace) |

| Tau-bench (Retail) | 63.9 | - | (출처: HuggingFace) |

OpenAI o3과 비교하면, AIME 2025에서 R1 0528(87.5%)이 o3(86.4%)를 근소하게 앞서지만, GPQA Diamond에서는 o3(87.7%)가 R1 0528(81.0%)를 앞선다 (출처: llm-stats.com, novita.ai). 전체적으로 수학에서는 대등하거나 우위, 과학 추론에서는 o3에 약간 뒤지는 구도다.

실사용 체감으로는, 벤치마크 수치보다 레이턴시 차이가 더 크게 느껴진다는 의견이 많다. OpenRouter 경유 시 15-30초 대기는 실시간 대화 용도로는 부담스럽고, 이 때문에 ChatGPT Plus를 유지하면서 배치 작업에만 R1을 쓴다는 사용자도 있다. 반면 가격 대비 성능이 워낙 좋아서 ChatGPT Plus 구독을 해지하고 DeepSeek으로 전환했다는 의견도 상당수 있다.

사용 방법

웹에서는 chat.deepseek.com에서 무료로 사용 가능하다. 별도 구독 없이 DeepThink(R1) 모드를 선택하면 0528 버전이 적용된다.

API 연동의 경우, platform.deepseek.com에서 API 키를 발급받아 사용한다. OpenAI SDK 호환이므로 기존 OpenAI 코드에서 base_url과 model명만 변경하면 된다. 신규 가입 시 크레딧이 제공된다.

OpenRouter, DeepInfra, Together.ai, Nebius 등 서드파티 제공자를 통해서도 API 접근이 가능하며, 각 제공자별로 가격과 속도가 다르다. 로컬 구동을 원한다면 HuggingFace에서 가중치를 다운로드하거나 GGUF 양자화 버전(Unsloth 제공)을 사용할 수 있다. 다만 671B 풀사이즈 모델은 상당한 GPU 메모리가 필요하므로, 경량 버전인 Qwen3-8B 증류 모델이 개인 사용에 더 현실적이다.

가격

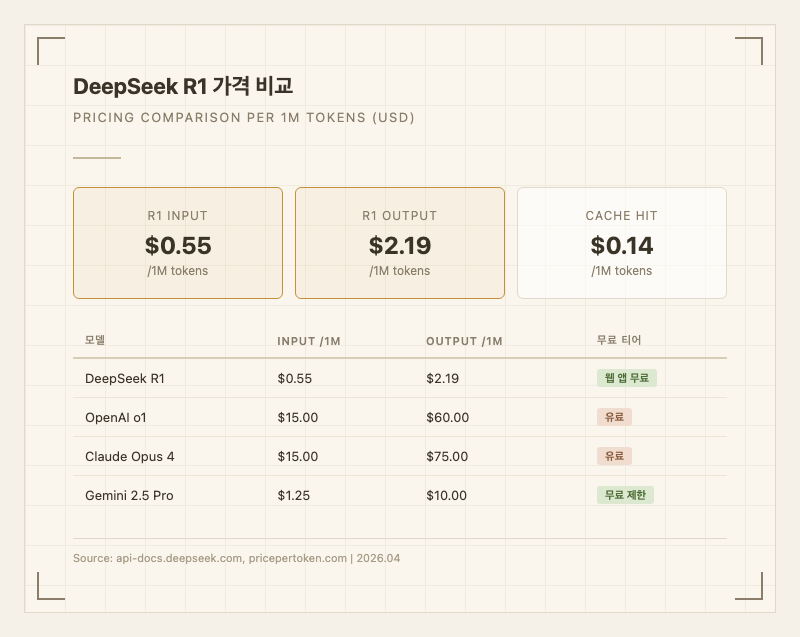

DeepSeek 공식 API 기준 입력 2.19/1M 토큰이다 (출처: api-docs.deepseek.com). 캐시 히트 시 입력 비용은 $0.14/1M 토큰으로 대폭 할인된다.

경쟁 모델과 비교하면 OpenAI o3 대비 입력 약 4배, 출력 약 3.7배 저렴하다 (출처: pricepertoken.com). Gemini 2.5 Pro(입력 10.00) 대비로도 상당히 경쟁력이 있다.

서드파티 제공자를 통하면 더 저렴해진다. DeepInfra는 블렌딩 가격 1.15/1M, Nebius 7-8/1M 수준으로 비싼 편이다.

실사용자들의 가성비 평가는 대체로 긍정적이다. "추론 모델 중에서 가격 대비 성능이 최고"라는 의견이 많고, 일부는 ChatGPT Plus 구독($20/월)을 해지하고 DeepSeek API로 전환했다는 후기도 있다. 다만 추론 모델 특성상 긴 사고 과정이 출력 토큰에 포함되어, 실제 비용이 예상보다 높아질 수 있다는 점은 주의가 필요하다.

한국어 토큰 효율 데이터는 공식적으로 미공개 상태다.

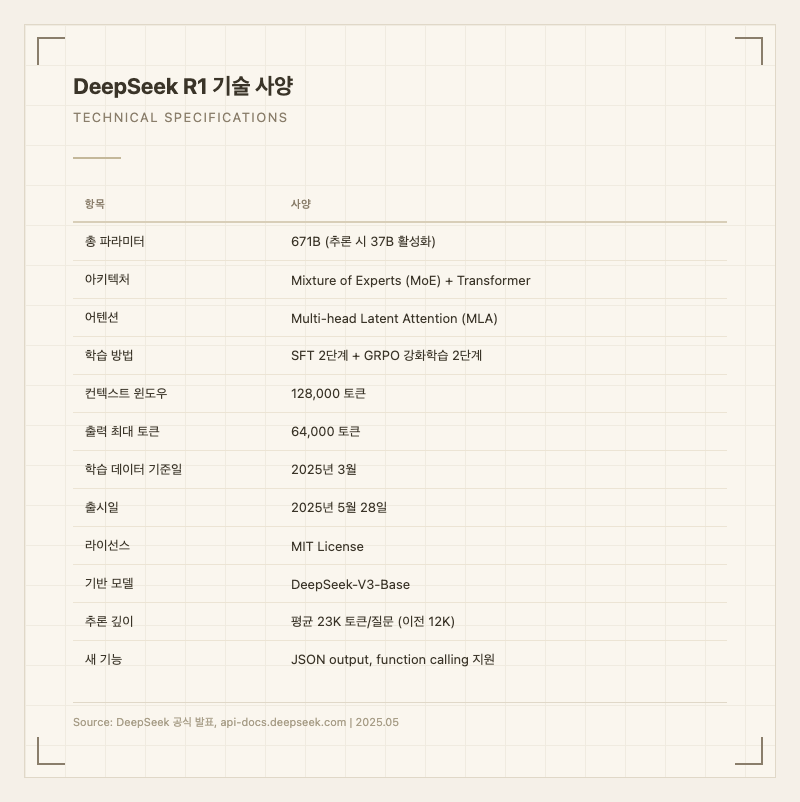

기술 사양

| 항목 | 사양 |

|---|---|

| 파라미터 | 671B 총 / 37B 활성화 (MoE) |

| 아키텍처 | Mixture of Experts + Transformer |

| 어텐션 | Multi-head Latent Attention (MLA) |

| 학습 방법 | SFT 2단계 + GRPO 강화학습 2단계 |

| 컨텍스트 윈도우 | 128,000 토큰 |

| 기반 모델 | DeepSeek-V3-Base |

| 학습 데이터 기준일 | 2025년 3월 |

| 출시일 | 2025년 5월 28일 |

| 라이선스 | MIT License |

| 추론 깊이 | 평균 23K 토큰/질문 (이전 12K) |

| 새 기능 | JSON 구조화 출력, function calling |

| 증류 모델 | DeepSeek-R1-0528-Qwen3-8B |

참고 자료

스펙

컨텍스트 윈도우

128K 토큰

라이선스

MIT License

출시일

2025년 5월 29일

학습 마감일

2025년 3월 31일

가성비 지수

3.1

API 가격 (혼합)

입력 $0.550/1M

조회수

0

API 가격 (USD 기준)

입력 (Prompt)

$0.55 / 1M 토큰

출력 (Completion)

$2.19 / 1M 토큰

용도별 성능

태스크 관련 벤치마크 평균 점수

수학/추론최강

89.2

수학, 과학, 논리적 추론

일반지식

85.0

다양한 분야 지식 및 이해

지시따르기

83.3

복잡한 지시사항 이해 및 수행

Provider

DeepSeek

DeepSeek의 다른 모델

분류

자연어 처리컴퓨터 비전오디오 처리TransformerLLM

성능 평가

꼭지점 클릭 → 벤치마크 행 이동

| 벤치마크 | 이 모델 | 단위 |

|---|---|---|

| Arena Elo | 1358.0 |

유사 모델 비교

| 모델 | LLM 점수GPQA·MMLU·MATH·IFEval·HumanEval |

|---|---|

| R1 0528 | 86.7 |

| o1-pro | 86.4 |

| o3 | 88.8 |

| Grok 4.1 Fast | 74.4 |

| Command A | 69.1 |