Claude 3.5 Haiku

AnthropicLLM자연어 처리컴퓨터 비전오디오 처리200K 토큰

2024년 11월 4일Proprietary

한줄 소개

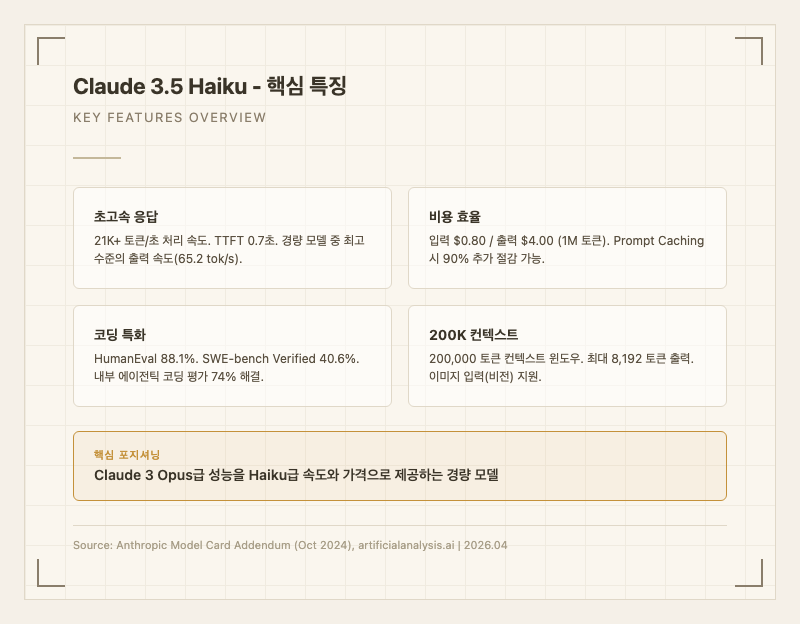

Claude 3.5 Haiku는 Anthropic이 2024년 10월에 출시한 경량 언어 모델로, Claude 3 Opus급 성능을 Haiku의 속도와 가격대에서 제공하는 것을 목표로 설계되었다. 이전 세대 Haiku 대비 전 영역에서 성능이 향상되었으며, 특히 코딩과 도구 사용 능력에서 두드러진 개선을 보인다.

주요 특징

Claude 3.5 Haiku의 가장 큰 차별점은 속도와 성능의 균형이다. 32K 토큰 미만 프롬프트 기준 초당 21,000 토큰 이상을 처리하며, Anthropic API 직접 연결 시 출력 속도 65.2 tok/s, TTFT(첫 토큰 응답 시간) 0.7초를 기록한다 (출처: artificialanalysis.ai). 이는 경량 모델 카테고리에서 최상위 수준이다.

코딩 능력이 특히 강력하다. HumanEval 88.1%로 코드 생성에서 높은 정확도를 보이며, SWE-bench Verified 40.6%는 경량 모델임에도 실제 소프트웨어 저장소의 버그를 자동 수정할 수 있는 수준이다. Anthropic 내부 에이전틱 코딩 평가에서는 74%의 문제를 해결했는데, 이는 당시 Claude 3.5 Sonnet(64%)보다도 높은 수치였다 (출처: Anthropic Model Card Addendum).

200,000 토큰 컨텍스트 윈도우를 지원하며 이미지 입력(비전)도 가능하다. Constitutional AI 안전성 프레임워크가 적용되어 있어 안전한 응답을 제공하면서도 빠른 처리가 가능하다.

실사용자들은 속도에 대해 일관되게 높은 평가를 내린다. Reddit의 한 개발자는 "이렇게 빨리 앱을 만들어본 적이 없다. Sonnet이 필요 없을 정도"라고 평가했다. 반면, 일부 사용자는 코드 리뷰의 일관성이 떨어지거나 문서 요약에서 핵심을 놓치는 경우가 있다고 보고했다.

할 수 있는 것

Claude 3.5 Haiku는 실시간 응답이 필요한 환경에 최적화되어 있다.

- 실시간 챗봇 및 고객 서비스 자동화: 낮은 지연 시간 덕분에 사용자 대면 서비스에 적합하다. 실사용자들은 채팅 인터페이스에서 체감 속도가 GPT-4o-mini보다 빠르다고 평가한다.

- 코드 생성 및 자동 완성: HumanEval 88.1%, SWE-bench Verified 40.6%의 코딩 능력으로 IDE 플러그인, 코드 리뷰 보조, 디버깅 자동화에 활용된다. 내부 에이전틱 코딩 평가 74% 해결률은 서브-에이전트 파이프라인에서도 신뢰할 수 있는 수준이다 (출처: Anthropic Model Card Addendum).

- 대량 텍스트 분류 및 콘텐츠 필터링: 빠른 속도와 낮은 비용으로 대규모 배치 처리에 유리하다. Batch API를 활용하면 50% 추가 비용 절감이 가능하다.

- 데이터 추출 및 구조화: 200K 컨텍스트 윈도우를 활용해 긴 문서에서 정보를 추출하고 JSON 등 구조화된 형식으로 변환하는 작업에 적합하다.

- 이미지 분석: 비전 기능을 지원하여 이미지 속 텍스트 인식, 차트 해석, 문서 스캔 등 멀티모달 작업도 가능하다.

다만 실사용자들의 피드백에 따르면, 복잡한 추론이 필요한 작업이나 미묘한 뉘앙스 판단이 필요한 경우에는 Sonnet급 모델에 비해 한계가 있다. "빠르고 단순한 작업은 탁월하지만, 깊이 있는 분석이 필요하면 Sonnet으로 넘어간다"는 것이 커뮤니티의 일반적인 평가다.

성능

벤치마크 점수

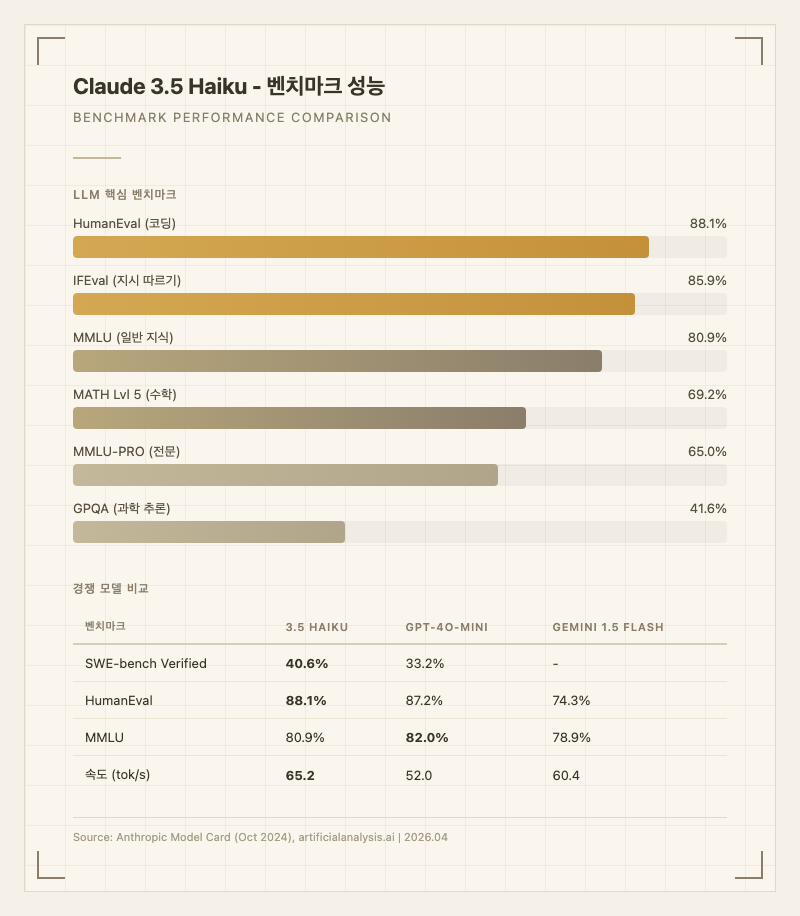

| 벤치마크 | 점수 | 설명 |

|---|---|---|

| GPQA | 41.6% | 과학 추론 - 한계 영역 (출처: Anthropic 공식) |

| MMLU-PRO | 65.0% | 전문 지식 - 기본 수준 (출처: Anthropic 공식) |

| MATH Lvl 5 | 69.2% | 수학 - 중급 이상 (출처: Anthropic 공식) |

| IFEval | 85.9% | 지시 따르기 - 안정적 (출처: Anthropic 공식) |

| HumanEval | 88.1% | 코딩 - 강점 영역 (출처: Anthropic 공식) |

| MMLU | 80.9% | 일반 지식 (출처: Anthropic 공식) |

| SWE-bench Verified | 40.6% | 에이전틱 코딩 (출처: Anthropic 공식) |

경쟁 모델 비교

같은 가격대의 경량 모델들과 비교하면, 코딩(HumanEval, SWE-bench)에서는 Claude 3.5 Haiku가 확실한 우위를 보인다. GPT-4o-mini의 SWE-bench Verified 33.2% 대비 40.6%로 상당한 차이가 있다. 반면 일반 지식(MMLU)에서는 GPT-4o-mini(82.0%)에 소폭 뒤진다 (출처: artificialanalysis.ai).

Artificial Analysis Intelligence Index에서 19점을 기록하여 평균(22점) 이하로 평가되었는데, 이는 과학 추론(GPQA 41.6%)이나 전문 영역(MMLU-PRO 65.0%)에서의 상대적 약점이 종합 점수를 끌어내리기 때문이다 (출처: artificialanalysis.ai).

실사용 체감으로는, 코딩과 도구 사용에서는 가격 대비 최고 수준이지만, 과학 논문 분석이나 고도의 추론이 필요한 작업에서는 힘이 부친다는 평가가 지배적이다. 한 Reddit 사용자는 6개월간 병행 사용 결과 "85%의 일상 업무에서는 Haiku로 충분하지만, 나머지 15%에서는 확실히 Sonnet이 필요하다"고 평가했다.

사용 방법

웹/앱 (일반 사용자)

claude.ai에서 무료 또는 Pro 구독($20/월)으로 사용할 수 있다. 무료 티어에서도 Claude 3.5 Haiku를 선택할 수 있으며, Pro 구독 시 더 많은 메시지 한도가 제공된다. iOS/Android 앱에서도 동일하게 이용 가능하다.

API (개발자)

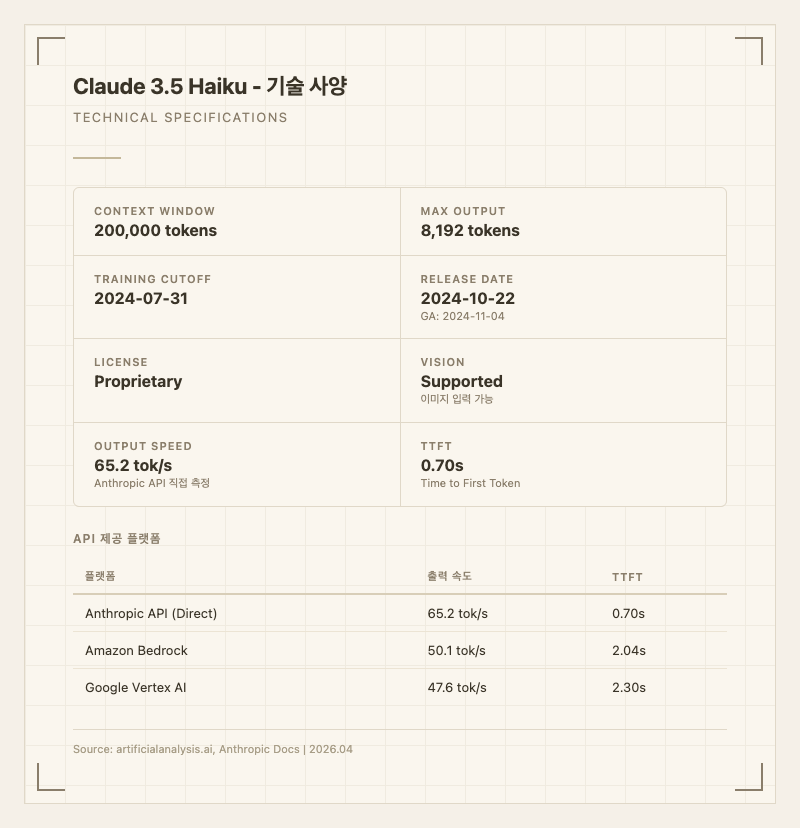

Anthropic API, Amazon Bedrock, Google Vertex AI 세 가지 경로로 API 접근이 가능하다.

POST https://api.anthropic.com/v1/messages

model: claude-3-5-haiku-20241022

Anthropic API 직접 연결이 가장 빠른 응답 속도(65.2 tok/s)를 제공하며, Bedrock이나 Vertex를 통하면 기존 클라우드 인프라와 통합하기 수월하다. 다만 Bedrock(50.1 tok/s)이나 Vertex(47.6 tok/s)는 직접 연결 대비 출력 속도가 다소 느리다 (출처: artificialanalysis.ai).

가격

API 가격

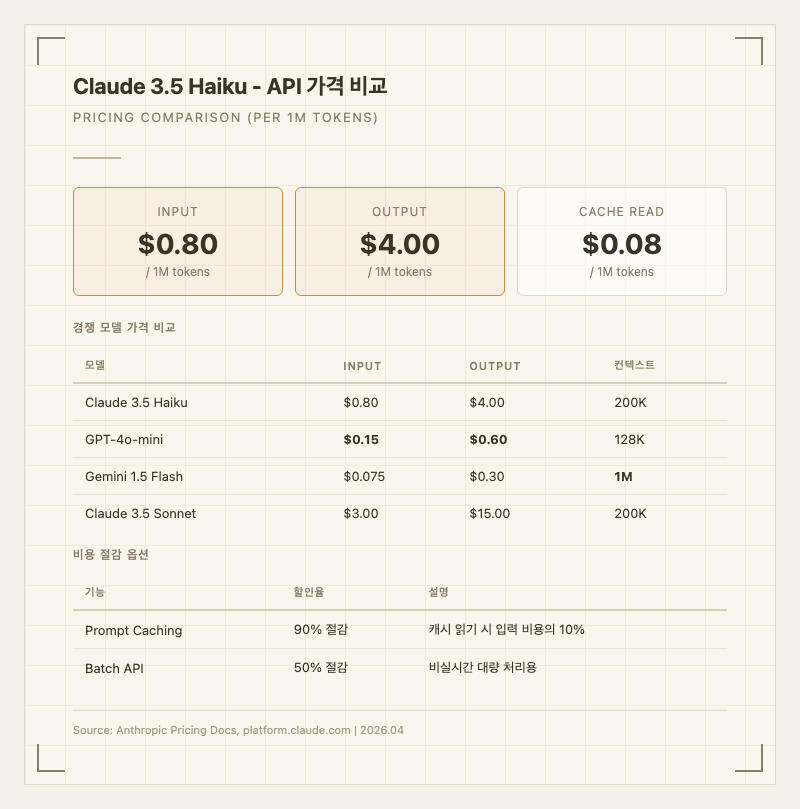

- 입력: $0.80 / 1M 토큰

- 출력: $4.00 / 1M 토큰

- Prompt Cache 읽기: $0.08 / 1M 토큰 (입력 비용의 10%)

- Batch API: 기본 가격 대비 50% 할인

경쟁 모델과의 비교

솔직히 말하면, 가격 경쟁력에서는 GPT-4o-mini(0.60)나 Gemini 1.5 Flash(0.30)에 밀린다. Claude 3.5 Haiku는 이들보다 4-10배 비싸다. 다만 코딩 품질과 지시 따르기 능력이 더 높기 때문에, "품질 우선"으로 경량 모델을 선택한다면 합리적인 선택이다.

Prompt Caching을 적극 활용하면 반복 호출 시 입력 비용을 90% 절감할 수 있고, 캐시 지속 시간은 5분이다. 대량 비실시간 처리에는 Batch API의 50% 할인이 효과적이다.

한국어 토큰 효율

Claude 모델은 영어 대비 한국어 토큰 효율이 낮은 것으로 알려져 있으나, Claude 3.5 Haiku의 한국어 토큰 효율에 대한 구체적인 공개 데이터는 미공개 상태이다. Anthropic 공식 문서에 따르면, 한국어를 포함한 주요 언어에서 영어 대비 80% 이상의 상대 성능을 유지한다고 밝히고 있다 (출처: platform.claude.com).

한국어 사용 시 특이사항으로, 나무위키 등 한국어 커뮤니티에서는 "영어 직역체를 구사하는 경향이 있으며, 응답이 길어질수록 이 경향이 심해진다"는 평가가 있다. Haiku는 Sonnet보다 이 경향이 더 두드러진다고 보고되고 있다.

기술 사양

| 항목 | 사양 |

|---|---|

| 모델 ID | claude-3-5-haiku-20241022 |

| 파라미터 수 | 미공개 |

| 컨텍스트 윈도우 | 200,000 토큰 |

| 최대 출력 | 8,192 토큰 |

| 아키텍처 | Transformer (상세 미공개) |

| 학습 데이터 기준일 | 2024-07-31 |

| 출시일 | 2024-10-22 (GA: 2024-11-04) |

| 라이선스 | Proprietary |

| 비전 | 지원 (이미지 입력) |

| 안전성 | Constitutional AI |

| 제공 플랫폼 | Anthropic API, Amazon Bedrock, Google Vertex AI |

2026년 4월 현재, Claude 3.5 Haiku는 여전히 서비스 중이나 후속 모델인 Claude Haiku 4.5(2025년 10월 출시)가 대부분의 벤치마크에서 상위 성능을 보이고 있다. 비용에 민감한 레거시 파이프라인이나 특정 지연 시간 요구사항이 있는 환경에서는 여전히 유효한 선택이다.

참고 자료

스펙

컨텍스트 윈도우

200K 토큰

라이선스

Proprietary

출시일

2024년 11월 4일

학습 마감일

2024년 7월 31일

가성비 지수

1.6

API 가격 (혼합)

입력 $0.800/1M

조회수

0

API 가격 (USD 기준)

입력 (Prompt)

$0.80 / 1M 토큰

출력 (Completion)

$4.00 / 1M 토큰

용도별 성능

태스크 관련 벤치마크 평균 점수

지시따르기최강

85.9

복잡한 지시사항 이해 및 수행

일반지식

65.0

다양한 분야 지식 및 이해

코딩

64.3

코드 생성, 버그 수정, 소프트웨어 엔지니어링

Provider

Anthropic

분류

자연어 처리컴퓨터 비전오디오 처리TransformerLLM

성능 평가

꼭지점 클릭 → 벤치마크 행 이동

| 벤치마크 | 이 모델 | 단위 |

|---|---|---|

| GPQA | 41.6 | % |

유사 모델 비교

| 모델 | LLM 점수GPQA·MMLU·MATH·IFEval·HumanEval |

|---|---|

| Claude 3.5 Haiku | 63.4 |

| o1-pro | 86.4 |

| o3 | 88.8 |

| Grok 4.1 Fast | 74.4 |

| Command A | 69.1 |