Claude Sonnet 4

AnthropicLLM자연어 처리컴퓨터 비전오디오 처리200K 토큰

2025년 5월 23일Proprietary

한줄 소개

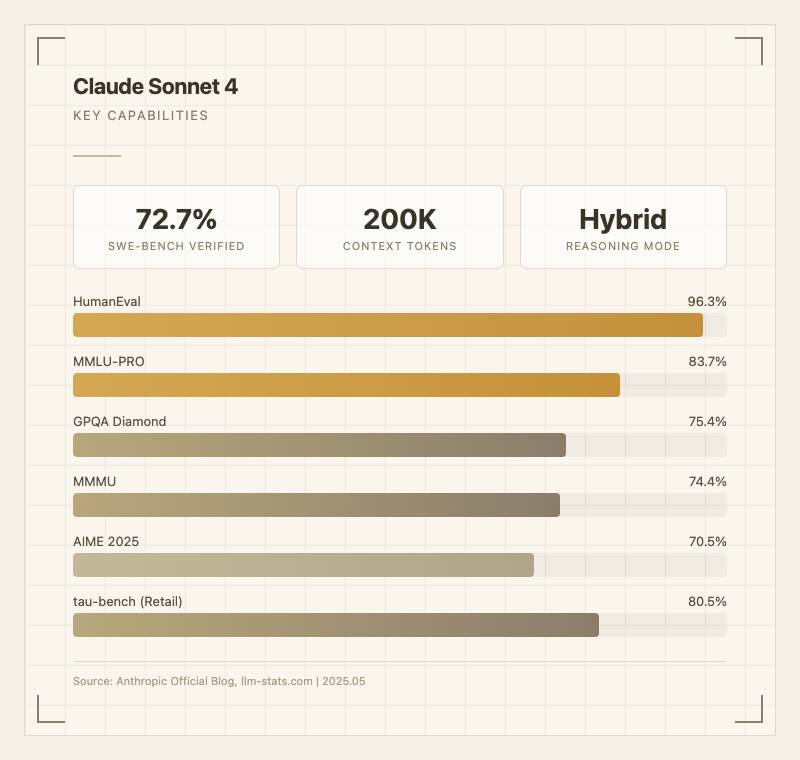

Claude Sonnet 4는 Anthropic이 2025년 5월 22일에 출시한 4세대 중급 AI 모델이다. Claude Opus 4와 함께 발표되었으며, 코딩과 에이전트 작업에 특화된 하이브리드 추론 모델로 설계되었다. Sonnet 라인업의 전통대로 성능과 비용의 균형을 잡는 것이 핵심 포지션이며, 실제로 SWE-bench Verified에서 72.7%를 기록하며 출시 당시 최상위 코딩 벤치마크 성적을 달성했다.

주요 특징

Claude Sonnet 4가 이전 세대 Sonnet 3.7과 구분되는 핵심 포인트는 다음과 같다.

하이브리드 추론 아키텍처: 즉시 응답 모드와 확장 사고(Extended Thinking) 모드를 상황에 따라 전환한다. 단순 질문에는 빠르게 답하고, 복잡한 추론이 필요한 경우 내부적으로 긴 사고 과정을 거친다. 확장 사고 모드에서는 GPQA Diamond가 70.0%에서 83.8%로, AIME가 33.1%에서 90.0%로 크게 상승한다 (출처: 공식 블로그).

코딩 에이전트 최적화: GitHub이 Copilot의 코딩 에이전트 구동 모델로 Claude Sonnet 4를 채택했다. 자율적으로 코드베이스를 탐색하고, 파일을 수정하며, 테스트를 실행하는 에이전트 워크플로우에 최적화되어 있다. 실사용자들은 "페어 프로그래머로 쓸 때 Sonnet이 가장 자연스럽다"고 평가한다 (출처: Reddit 커뮤니티 후기).

정밀한 지시 수행력(Steerability): Anthropic이 특히 강조한 개선 사항이다. 복잡한 지시를 정확히 따르는 능력이 향상되었고, 에이전트 시나리오에서의 오류율이 감소했다. 실제로 "Sonnet 4는 컨텍스트를 먼저 읽고 나서 코드를 수정한다"는 평가가 개발자 커뮤니티에서 자주 나온다.

도구 사용 중 추론: 확장 사고 모드에서 웹 검색 등 도구를 호출하면서 동시에 추론을 이어갈 수 있다. 추론과 도구 사용을 번갈아 수행하는 것은 에이전트 작업에서 핵심적인 차별점이다.

멀티모달 입력: 텍스트와 이미지를 동시에 입력받아 처리할 수 있으며, MMMU(시각적 추론) 벤치마크에서 74.4%를 달성했다 (출처: llm-stats.com).

할 수 있는 것

코딩 에이전트: Sonnet 4가 가장 빛나는 영역이다. Claude Code와 결합하면 대규모 코드베이스에서 자율적으로 이슈를 분석하고, 코드를 수정하고, 테스트를 돌리는 전체 워크플로우를 수행한다. Reddit 개발자들은 "git 작업이나 bash 스크립팅 같은 비코딩 CLI 작업에서도 편하다"고 평가한다. SWE-bench Verified 72.7%라는 수치가 이를 뒷받침하는데, 고컴퓨팅 환경에서는 80.2%까지 올라간다 (출처: 공식 블로그).

대규모 코드 리뷰: 200K 토큰 컨텍스트 윈도우(베타로 1M까지 확장 가능)를 활용해 전체 프로젝트를 한 번에 분석할 수 있다. "아키텍처 토론이나 큰 기능 단위의 설계에서 특히 강하다"는 평가가 있다 (출처: Reddit 커뮤니티).

전문 분야 질의응답: GPQA Diamond 75.4%로 대학원 수준의 과학/수학 문제에서 경쟁력 있는 성능을 보인다. MMLU 86.5%, MMLU-PRO 83.7%로 광범위한 지식 영역을 커버한다 (출처: llm-stats.com).

GUI 기반 컴퓨터 사용: OSWorld 43.9%로 GUI 환경에서의 자동화 작업에서도 의미 있는 성능을 보여준다. 웹 브라우저 조작, 데스크톱 앱 자동화 등 컴퓨터 사용 에이전트로서의 역할이 가능하다 (출처: llm-stats.com).

다만 한계도 있다: 수학 경시대회 수준의 문제에서는 AIME 70.5%로 Gemini 2.5 Pro(86.7%)에 뒤처진다. TerminalBench 35.5%는 CLI 환경 코딩에서 아직 개선 여지가 있음을 보여준다. 한국어 사용자들 사이에서는 "영어 대비 한국어 응답 품질이 약간 떨어진다"는 피드백이 있으며, 한국어 토큰 효율 데이터는 미공개 상태다.

성능

벤치마크 요약

| 벤치마크 | 점수 | 카테고리 | 출처 |

|---|---|---|---|

| SWE-bench Verified | 72.7% | Agentic | 공식 블로그 |

| HumanEval | 96.3% | LLM | llm-stats.com |

| GPQA Diamond | 75.4% | LLM | 공식 블로그 |

| MMLU-PRO | 83.7% | LLM | llm-stats.com |

| MMLU | 86.5% | Capability | llm-stats.com |

| MMMU | 74.4% | Capability | llm-stats.com |

| OSWorld | 43.9% | Agentic | llm-stats.com |

| AIME 2025 | 70.5% | 수학 | llm-stats.com |

| TerminalBench | 35.5% | Agentic | 공식 블로그 |

| tau-bench (Retail) | 80.5% | Agentic | 공식 블로그 |

| tau-bench (Airline) | 60.0% | Agentic | 공식 블로그 |

경쟁 모델 비교

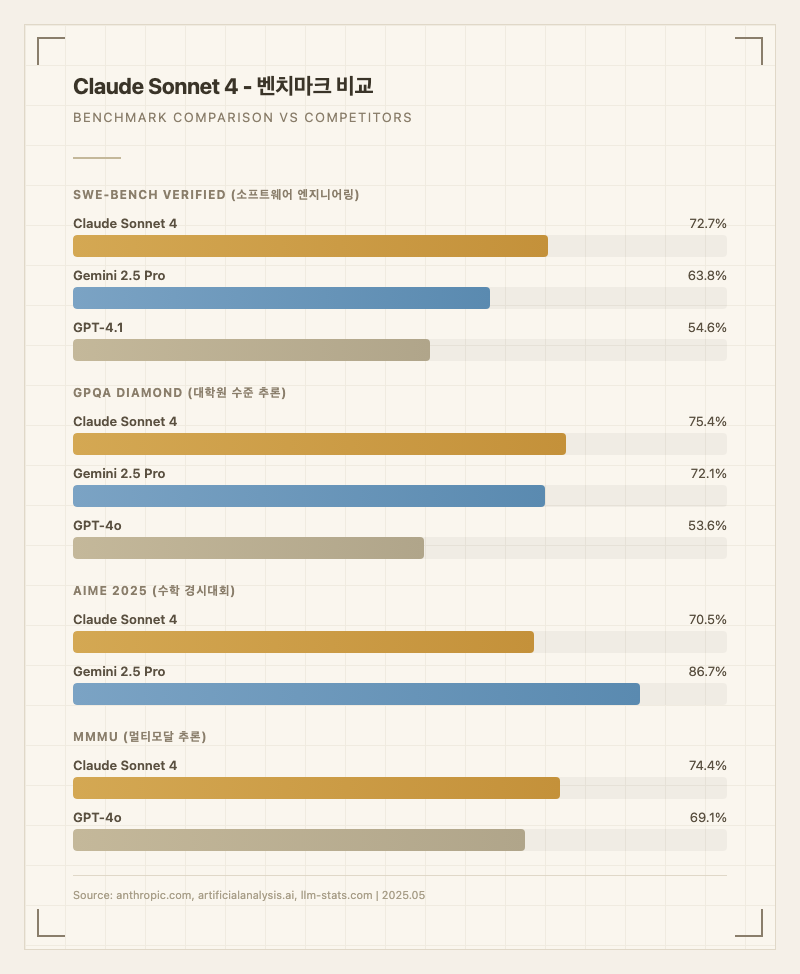

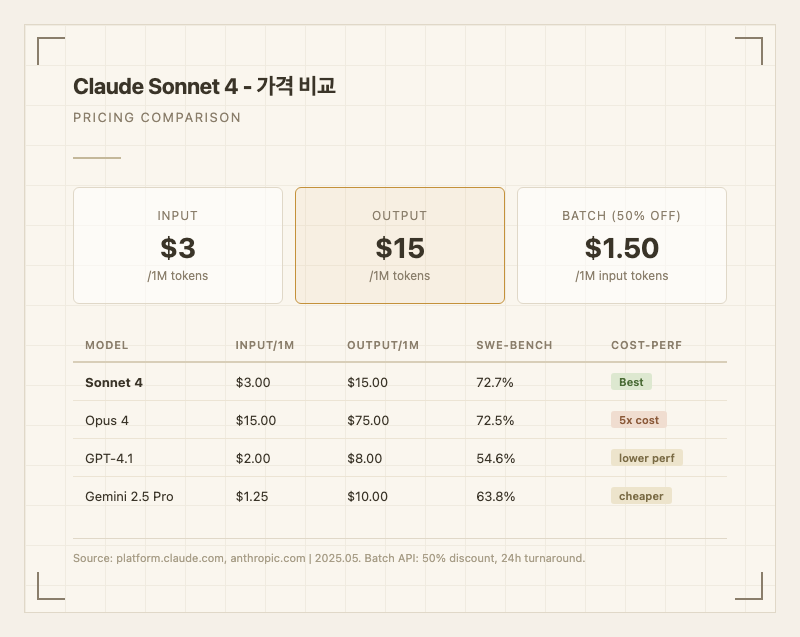

코딩 벤치마크에서 Sonnet 4는 같은 가격대의 경쟁 모델을 압도한다. SWE-bench Verified 72.7%는 GPT-4.1의 54.6%, Gemini 2.5 Pro의 63.8%를 크게 앞선다 (출처: 공식 블로그, analyticsvidhya.com). 같은 Anthropic 라인업의 Opus 4(72.5%)와 비슷한 수준이면서 가격은 5분의 1이라는 점이 핵심 가성비 포인트다.

반면 수학과 추론 영역에서는 Gemini 2.5 Pro가 더 강하다. AIME에서 Gemini 2.5 Pro는 86.7%를 기록해 Sonnet 4의 70.5%를 앞선다. 순수 추론 성능만 따지면 중상위권이지만, 코딩과 에이전트 작업에서의 우위가 전체 가치를 끌어올린다.

실사용자들의 체감 평가를 보면, "벤치마크 수치보다 실제 코딩 작업에서의 안정성이 더 인상적이다"는 의견이 많다. 특히 "복잡한 로직을 다룰 때 차트 라이브러리, API 통합, 상태 관리 패턴 사이의 컨텍스트 전환을 놓치지 않는다"는 구체적인 후기가 있다 (출처: Reddit 커뮤니티). 반면 "사용량 제한에 자주 걸린다"는 불만도 Pro 구독자($20/월) 사이에서 빈번하게 나온다.

사용 방법

웹/앱 (일반 사용자): claude.ai에서 무료로 사용 가능하다. Pro 플랜(100/월, $200/월), Team 플랜, Enterprise 플랜이 있다. 무료 사용자도 Sonnet 4에 접근할 수 있지만, 사용량에 제한이 있다.

API (개발자): Anthropic API(platform.claude.com), Amazon Bedrock, Google Cloud Vertex AI를 통해 사용 가능하다. 모델 ID는 claude-sonnet-4-20250514이다. 확장 사고 모드는 API에서 별도 파라미터로 활성화하며, 1M 컨텍스트 윈도우는 베타 헤더(context-1m-2025-08-07)를 추가해서 사용한다.

Claude Code (에이전트 개발자): 터미널에서 claude 명령어로 실행하는 에이전트 코딩 도구로, Sonnet 4가 기본 모델이다. 코드베이스 탐색, 파일 수정, 테스트 실행 등을 자율적으로 수행한다.

가격

구독 요금: 무료 티어(제한적), Pro 100/월 또는 $200/월. Team과 Enterprise는 별도 문의.

API 가격: 입력 15.00/1M 토큰. Batch API 사용 시 50% 할인(7.50)이 적용되며 24시간 이내 처리된다. 프롬프트 캐싱으로 반복 입력 비용을 추가 절감할 수 있다.

가성비 평가: Opus 4와 거의 동일한 코딩 성능(SWE-bench 72.7% vs 72.5%)을 5분의 1 가격에 제공한다는 점이 최대 장점이다. GPT-4.1(8)보다 비싸지만 코딩 성능이 월등히 높고, Gemini 2.5 Pro(10)보다 비싸지만 SWE-bench에서 약 9%p 앞선다. 실사용자들은 "코딩 에이전트 용도로는 Sonnet 4의 가성비가 최고"라고 평가하지만, "Pro 플랜의 사용량 제한이 빡빡하다"는 불만도 있다 (출처: Reddit, gamsgo.com).

한국어 토큰 효율 데이터는 미공개이나, Anthropic의 공식 문서에 따르면 한국어는 "고자원 언어"로 분류되어 영어 대비 80% 이상의 성능을 유지한다고 밝히고 있다 (출처: platform.claude.com 다국어 지원 문서).

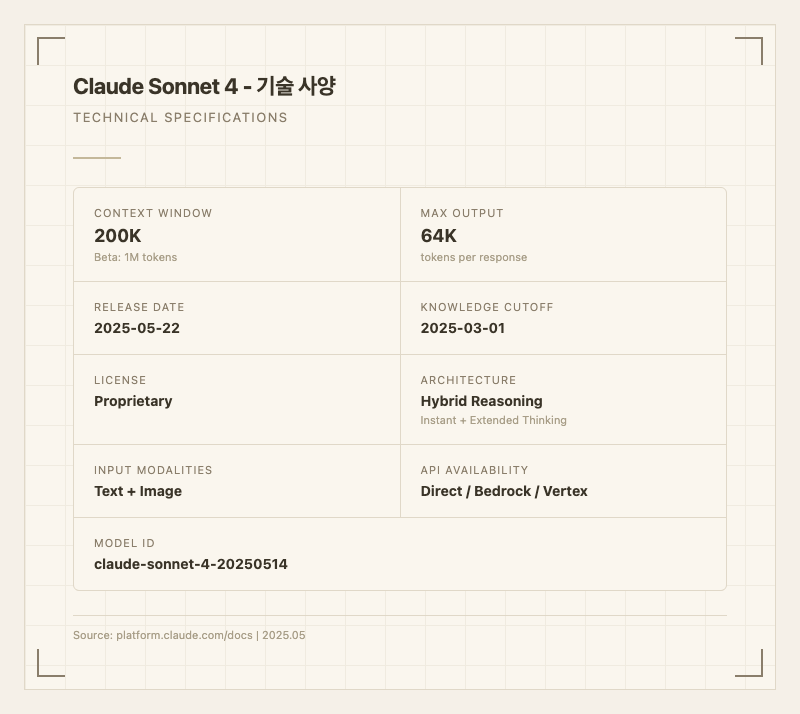

기술 사양

| 항목 | 사양 |

|---|---|

| 모델 ID | claude-sonnet-4-20250514 |

| 개발사 | Anthropic |

| 출시일 | 2025년 5월 22일 |

| 컨텍스트 윈도우 | 200,000 토큰 (베타: 1,000,000 토큰) |

| 최대 출력 | 64,000 토큰 |

| 입력 모달리티 | 텍스트, 이미지 |

| 출력 모달리티 | 텍스트 |

| 지식 기준일 | 2025년 3월 1일 |

| 학습 데이터 마감 | 2025년 1월 31일 |

| 라이선스 | Proprietary (독점) |

| 아키텍처 | 하이브리드 추론 (즉시 응답 + 확장 사고) |

| API 가격 | 입력 15.00/1M |

| 제공 플랫폼 | Anthropic API, Amazon Bedrock, Google Cloud Vertex AI |

| 파라미터 수 | 비공개 |

참고 자료

스펙

컨텍스트 윈도우

200K 토큰

라이선스

Proprietary

출시일

2025년 5월 23일

학습 마감일

2025년 1월 31일

가성비 지수

0.5

API 가격 (혼합)

입력 $3.00/1M

조회수

0

API 가격 (USD 기준)

입력 (Prompt)

$3.00 / 1M 토큰

출력 (Completion)

$15.00 / 1M 토큰

용도별 성능

태스크 관련 벤치마크 평균 점수

일반지식최강

83.7

다양한 분야 지식 및 이해

멀티모달

74.4

이미지, 비디오 등 멀티모달 이해

수학/추론

73.0

수학, 과학, 논리적 추론

Provider

Anthropic

분류

자연어 처리컴퓨터 비전오디오 처리TransformerLLM

성능 평가

꼭지점 클릭 → 벤치마크 행 이동

| 벤치마크 | 이 모델 | 단위 |

|---|---|---|

| AIME 2026 | 70.5 | % |

유사 모델 비교

| 모델 | LLM 점수GPQA·MMLU·MATH·IFEval·HumanEval |

|---|---|

| Claude Sonnet 4 | 81.8 |

| o1-pro | 86.4 |

| o3 | 88.8 |

| Grok 4.1 Fast | 74.4 |

| Command A | 69.1 |